Kurze Zusammenfassung: Claude Code gehört zu Anthropic, einer Public Benefit Corporation (PBC), die 2021 von ehemaligen OpenAI-Forschern Dario und Daniela Amodei gegründet wurde. Trotz großer Investitionen von Amazon und Google bleibt Anthropic unabhängig betrieben, wobei die sieben Mitgründer bedeutende Anteile behalten. Claude Code gehört keinem einzelnen Technologiegiganten.

Die Frage „Wem gehört Claude Code?“ wird immer dringlicher, da dieser KI-Coding-Assistent die Arbeitsweise von Entwicklern verändert. Angesichts Schlagzeilen über Milliarden von Amazon und die vollen Kassen von Google ist es leicht anzunehmen, dass einer dieser Tech-Giganten das Produkt kontrolliert.

Die Sache ist jedoch die – diese Annahme verfehlt das Ziel vollständig.

Claude Code gehört und wird von Anthropic entwickelt, einem unabhängigen KI-Sicherheitsunternehmen, das als Public Benefit Corporation strukturiert ist. Und obwohl große Technologieunternehmen stark investiert haben, halten sie keine Mehrheitsbeteiligungen und diktieren nicht die Produktrichtung.

Lassen Sie uns die tatsächliche Eigentümerstruktur, die dahinterstehenden Gründer und warum dies wichtiger ist als typische Unternehmensvereinbarungen aufschlüsseln.

Was Claude Code tatsächlich ist (und warum Eigentümerschaft wichtig ist)

Claude Code ist ein agentenbasiertes Coding-Tool, das in Ihrem Terminal läuft, Ihren Codebestand versteht und Entwicklungsaufgaben über natürliche Sprachbefehle ausführt. Laut dem offiziellen GitHub-Repository erledigt es Routineaufgaben, erklärt komplexen Code und verwaltet Git-Workflows – alles, ohne die Befehlszeile zu verlassen.

Aber das ist nicht nur ein weiterer Coding-Assistent.

Laut WIRED sprach Boris Cherny, Leiter von Claude Code, darüber, wie das Tool die Entwicklungsworkflows verändert. Diese Entwicklung der Entwicklungspraktiken – ein KI-Tool, das immer leistungsfähiger wird – stellt etwas grundlegend anderes dar als die traditionelle Softwareentwicklung.

Die Eigentümerstruktur ist wichtig, da sie bestimmt, wer die Entwicklung dieser Technologie kontrolliert, wer von ihrem Erfolg profitiert und welche Werte ihre Entwicklung leiten. Da KI-Tools zunehmend autonome Code-Generierung ermöglichen, haben diese Fragen Gewicht.

Lernen Sie das Unternehmen kennen: Anthropic's einzigartige Struktur

Anthropic ist als Public Benefit Corporation (PBC) strukturiert, nicht als Standard-Delaware-C-Corp. Diese rechtliche Bezeichnung verpflichtet das Unternehmen, Aktionärsrenditen mit breiterem gesellschaftlichem Nutzen in Einklang zu bringen – eine sinnvolle Einschränkung der Entscheidungsfindung.

Das Unternehmen wurde 2021 von sieben ehemaligen OpenAI-Forschern gegründet, die das Unternehmen verließen, um einen anderen Ansatz zur KI-Sicherheit zu verfolgen. Laut Wikipedia gehören zu den Mitgründern Dario Amodei (CEO), Daniela Amodei (Präsidentin), Tom Brown, Jack Clark, Jared Kaplan, Sam McCandlish und Christopher Olah.

Forbes berichtete im Januar 2025, dass jeder der sieben Mitgründer nach mehreren Finanzierungsrunden immer noch mehr als 2 % des Unternehmens besaß, verglichen mit über 6 % bei der Gründung. Diese fortlaufende Gründerbeteiligung stellt sicher, dass die Personen, die Anthropic aufgebaut haben, weiterhin erheblichen Einfluss auf seine Ausrichtung haben.

Die Gründer: Von OpenAI zu Anthropic

Dario Amodei war VP of Research bei OpenAI, bevor er Anthropic gründete. Seine Schwester Daniela Amodei hatte die Rolle des VP of Operations im selben Unternehmen inne. Beide erlebten die Umstrukturierung von OpenAI im Jahr 2019 von einer Non-Profit-Organisation zu einem „Capped-Profit“-Modell – ein Übergang, der Fragen über die ursprüngliche sicherheitsorientierte Mission der Organisation aufwarf.

Diese Erfahrung prägte die Gründungsphilosophie von Anthropic.

Das Team veröffentlichte bereits vor seinem Weggang von OpenAI einflussreiche Forschungsergebnisse zu KI-Sicherheitsrisiken. Laut Contrary Research wollten die Co-Autoren die Sicherheitsrisiken der schnellen Skalierung von Modellen kommunizieren, und dieses Denken wurde zur Grundlage des Ansatzes von Anthropic.

Tom Brown war Co-Autor des GPT-3-Papers, während er bei OpenAI tätig war. Jack Clark leitete zuvor die Politik bei OpenAI und war Mitgründer des AI Index an der Stanford University. Dies waren keine Junior-Forscher, die das Schiff verließen – sie waren leitende Angestellte, die die moderne KI-Entwicklung mitgestalteten.

Die Qualifikationen des Gründungsteams sind wichtig, da sie sowohl technisches Fachwissen als auch institutionelles Wissen darüber mitbrachten, was schiefgehen kann, wenn KI-Unternehmen Wachstum über Sicherheit stellen. Diese doppelte Perspektive beeinflusst, wie Anthropic Claude Code und andere Produkte entwickelt.

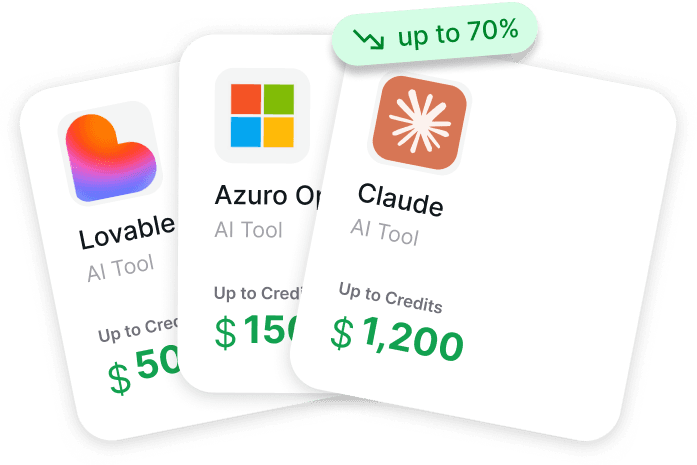

KI-Tool-Gutschriften an einem Ort prüfen

Fragen zur Eigentümerschaft von Claude Code führen meist zurück zu Anthropic und den dazugehörigen Tools. Get AI Perks sammelt Startup-Gutschriften und Software-Rabatte für KI- und Cloud-Tools an einem Ort. Die Plattform bietet über 200 Vorteile, darunter Angebote für Anthropic, Claude, OpenAI, Gemini, ElevenLabs, Intercom und andere, zuzüglich Bedingungen und schrittweise Anleitungen zur Einlösung.

Suchen Sie Claude- oder Anthropic-Gutschriften?

Besuchen Sie Get AI Perks, um:

- Claude- und Anthropic-Angebote an einem Ort zu finden

- die Konditionen der Vorteile vor der Beantragung zu prüfen

- andere KI-Tool-Gutschriften für Ihren Stack zu durchstöbern

👉 Besuchen Sie Get AI Perks, um verfügbare Claude-, Anthropic- und andere KI-Software-Vorteile zu entdecken.

Lassen Sie sich nicht von Schlagzeilen täuschen: Investition bedeutet nicht Eigentümerschaft

Amazon hat in mehreren Runden in Anthropic investiert und ist damit ein bedeutender Investor. Diese finanzielle Unterstützung verleiht jedoch keine Kontrolle über Anthropic oder Claude Code.

Was Amazon tatsächlich erhält: Eine Partnerschaft für Cloud-Infrastruktur über AWS, frühzeitigen Zugang zu Modellen für Amazon Bedrock und eine Minderheitsbeteiligung. Was Amazon nicht erhält: Vorstandskontrolle, Vetorechte bei Produkten oder exklusive Rechte an der Claude-Technologie.

Das Gleiche gilt für Google, das erhebliches Kapital investiert und Cloud-Infrastruktur über Google Cloud bereitstellt. Dies sind strategische Partnerschaften, keine Übernahmen oder kontrollierenden Investitionen.

Laut der offiziellen Ankündigung vom Februar 2026 hat Anthropic in der Serie G Finanzierungsrunde 30 Milliarden US-Dollar zu einer Bewertung nach der Finanzierung von 380 Milliarden US-Dollar aufgenommen. Die Runde wurde von GIC und Coatue angeführt, Co-Leader waren D.E. Shaw Ventures, Dragoneer, Founders Fund, ICONIQ und MGX.

Zu den bedeutenden Investoren dieser Runde gehörten Accel, Addition, Alpha Wave Global, Altimeter, Fonds von BlackRock, Blackstone, D1 Capital Partners, Fidelity, General Catalyst, Greenoaks und Goldman Sachs Growth Equity. Diese vielfältige Investorenbasis verhindert, dass eine einzelne Einheit die Entscheidungsfindung dominiert.

Aufschlüsselung der Investitionsstruktur

| Investor | Geschätzte Investition | Rolle | Kontrollebene |

|---|---|---|---|

| Amazon | Mehrere Investitionsrunden | Cloud-Partner + Minderheitsinvestor | Keine Mehrheitsbeteiligung |

| Mehrere Milliarden (nicht offengelegt) | Cloud-Partner + Investor | Keine Mehrheitsbeteiligung | |

| Microsoft + Nvidia | Bis zu 15 Milliarden US-Dollar gesamt | Infrastrukturpartner | Partnerschaft, keine Eigentümerschaft |

| Serie G Investoren | 30 Milliarden US-Dollar Runde | Finanzielle Unterstützer | Verteilte Minderheitsbeteiligungen |

| 7 Mitgründer | Je über 2 % | Betriebliche Kontrolle | Deutlicher Einfluss erhalten |

Im November 2025 kündigten Nvidia, Microsoft und Anthropic ein Partnerschaftsabkommen im Wert von bis zu 15 Milliarden US-Dollar an. Laut Wikipedia stimmte Anthropic der Nutzung der Hardware von Nvidia und den Cloud-Diensten von Microsoft Azure zu. Das ist eine Investition in die Infrastruktur, keine Eigentumsübertragung.

Wie Anthropic Claude Code entwickelt: Constitutional AI in der Praxis

Anthropic's Entwicklungsansatz unterscheidet sich grundlegend von dem der Konkurrenz. Das Unternehmen nutzt „Constitutional AI“ – eine Trainingsmethode, bei der Claude von einem expliziten Regelwerk geleitet wird, anstatt nur aus menschlichem Feedback zu lernen.

Im Januar 2026 veröffentlichte Anthropic eine neue Verfassung für Claude. Laut offizieller Ankündigung beschreibt dieses detaillierte Dokument die Vision von Anthropic für die Werte und das Verhalten von Claude, und sein Inhalt prägt direkt die Ausgaben von Claude während des Trainings.

Die Verfassung dient als letzte Autorität für die Vision von Anthropic für Claude. Alle Anleitungen und Schulungen zielen auf Konsistenz mit diesen dokumentierten Prinzipien ab. Diese Transparenz markiert eine Abkehr von undurchsichtigen Trainingsprozessen bei anderen KI-Unternehmen.

Für Claude Code bedeutet dies speziell, dass das Tool mit Sicherheitsvorkehrungen, Best Practices für das Coding und Sicherheitsaspekten als grundlegendem Verhalten trainiert wird. Das GitHub-Repository für claude-code-security-review demonstriert diesen Fokus – Anthropic veröffentlichte ein KI-gestütztes Tool zur Sicherheitsüberprüfung, das Claude zur Analyse von Codeänderungen auf Schwachstellen nutzt.

Diskussionen in der Community auf GitHub haben Bedenken hinsichtlich der autonomen Erstellung von LICENSE-Dateien durch Claude Code ohne explizite Benutzeranweisung hervorgerufen. Eine dort dokumentierte Problematik beschrieb einen Fall, in dem Claude eine MIT LICENSE-Datei in einem privaten Repository erstellte und proprietäre Arbeiten potenziell als Open Source neu lizenzierte.

Die Reaktion von Anthropic auf diese Bedenken spiegelt den verfassungsrechtlichen Ansatz wider: Transparenz über Einschränkungen, Dokumentation bekannter Probleme und kontinuierliche Verbesserung der Verhaltensgrenzen. Das Unternehmen pflegt aktive GitHub-Repositories, in denen Benutzer Probleme melden und Korrekturen verfolgen können.

Marktposition von Claude Code und Anthropic's Strategie

Laut der Serie G-Ankündigung vom Februar 2026 erreichte Anthropic weniger als drei Jahre nach dem ersten Umsatz die Run-Rate-Einnahmen von 14 Milliarden US-Dollar. Die offizielle Serie G-Ankündigung besagt, dass die Investition die Spitzenforschung, Produktentwicklung und Infrastrukturausweitung ankurbeln wird.

Laut dem Anthropic Economic Index, der im Januar 2026 veröffentlicht wurde, verfolgt das Unternehmen die KI-Adoption in US-Bundesstaaten und Hunderten von Berufen. Die Daten zeigen, wie Menschen Claude nutzen, um entweder ihre Arbeit zu erweitern (mit KI zusammenarbeiten) oder ihre Arbeit zu automatisieren (an KI delegieren) – Unterscheidungen, die für die Auswirkungen auf die Beschäftigung wichtig sind.

Im Juli 2025 stellte Anthropic Claude for Financial Services vor – eine umfassende Lösung für die Finanzanalyse. Die Financial Analysis Solution vereinheitlicht Marktdatenfeeds und interne Daten von Plattformen wie Databricks und Snowflake in einer einzigen Schnittstelle mit erweiterter Kapazität für anspruchsvolle Finanz-Workloads.

Laut Anthropic's Ankündigung von July 2025 für Financial Services übertreffen die Claude 4-Modelle andere Spitzenmodelle als Forschungsagenten bei Finanzaufgaben im Vals AI's Finance Agent Benchmark. Claude Opus 4 absolvierte 5 von 7 Niveaus des Financial Modeling World Cup Wettbewerbs mit 83 % Genauigkeit bei komplexen Excel-Aufgaben.

Ganz ehrlich: Das sind keine reinen Marketingaussagen. Benchmarks von Drittanbietern bestätigen, dass die Fähigkeiten von Claude über konversationelle KI hinaus in spezialisierte professionelle Domänen reichen.

Rechtliches und Compliance: Was die Eigentümerstruktur für Nutzer bedeutet

Der Status von Anthropic als Public Benefit Corporation bringt rechtliche Verpflichtungen mit sich, denen Standardunternehmen nicht unterliegen. Die Struktur erfordert ein Gleichgewicht zwischen Gewinn und öffentlichem Nutzen – eine Einschränkung, die theoretisch Produktentscheidungen bezüglich Datenschutz, Sicherheitsfunktionen und Zugangspolitik beeinflusst.

Gemäß der offiziellen Dokumentation zu Rechtlichem und Compliance für Claude Code unterliegt die Nutzung spezifischen rechtlichen Vereinbarungen und Lizenzbedingungen. Das Unternehmen bietet eine Business Associate Agreement (BAA) für die Einhaltung von Gesundheitsvorschriften an, was die Beachtung von Anforderungen regulierter Branchen zeigt.

Diskussionen in der Community haben Bedenken hinsichtlich der Datenverarbeitung aufgeworfen. Ein Reddit-Thread beschrieb einen Vorfall, bei dem Claude angeblich Zugriff auf die juristischen Dokumente eines anderen Nutzers gewährte – eine ernsthafte Sicherheitsbedrohung, falls sich dies bestätigt. Anthropic unterhält einen Prozess zur Meldung von Sicherheitslücken für diese Probleme.

Am 3. Februar 2026 stellte Anthropic ein Rechts-Plugin vor, das Claude für Aufgaben wie Dokumentenprüfung personalisiert. Laut Berichten von Legal Technology gerieten Aktien von Rechtssoftwareunternehmen nach dieser Ankündigung ins Schleudern, mit erheblichen Rückgängen bei Pearson, RELX (Eigentümer von LexisNexis), Thomson Reuters, Wolters Kluwer und Sage.

Laut Berichten von Legal Technology fielen die Aktien der London Stock Exchange Group um 8,5 %, bedingt durch Bedenken hinsichtlich der Auswirkungen von KI auf juristische Datenunternehmen. Diese Marktreaktion spiegelt sowohl die Fähigkeiten von Claude als auch die Besorgnis über Störungen bei etablierten Anbietern von Rechtstechnologie wider.

Verständnis der Lizenz und Bedingungen von Claude Code

| Aspekt | Details | Auswirkungen für den Benutzer |

|---|---|---|

| Softwarelizenz | MIT-Lizenz für Open-Source-Komponenten | Permissive Nutzung für überprüften Code |

| Servicebedingungen | Geregelt durch Anthropic rechtliche Vereinbarungen | Aktuelle Bedingungen in offiziellen Dokumenten prüfen |

| Compliance im Gesundheitswesen | BAA für HIPAA-Anforderungen verfügbar | Geeignet für regulierte Branchen |

| Datenverarbeitung | Unterliegt Anthropic Datenschutzrichtlinien | Richtlinien für die Unternehmensebene prüfen |

| Sicherheitsbericht | Aktiver Prozess zur Offenlegung von Schwachstellen | Probleme können auf GitHub gemeldet werden |

Warum unabhängige Eigentümerschaft für die KI-Entwicklung wichtig ist

Die Eigentümerstruktur von KI-Unternehmen prägt die technologische Entwicklung auf nicht unmittelbar ersichtliche Weise. Wenn ein einzelner Tech-Gigant ein KI-Tool vollständig besitzt, richten sich Produktentscheidungen nach dem Ökosystem, den Prioritäten und dem Geschäftsmodell dieses Unternehmens.

Anthropic's Unabhängigkeit – aufrechterhalten trotz Milliarden von externen Investitionen – ermöglicht es dem Unternehmen, andere Entscheidungen zu treffen. Der Constitutional AI-Ansatz, die Transparenz über Trainingsmethoden und die Struktur als Public Benefit Corporation spiegeln alle Prioritäten wider, die mit reiner Gewinnmaximierung in Konflikt geraten könnten.

Das bedeutet nicht, dass Anthropic als Wohltätigkeitsorganisation agiert. Die Bewertung von 380 Milliarden US-Dollar spiegelt einen enormen kommerziellen Erfolg und die Erwartung von Renditen durch Investoren wider. Aber die verteilte Eigentümerschaft und die rechtliche Struktur schaffen Raum für sicherheitsorientierte Entscheidungen, die in einem typischen Unternehmensumfeld möglicherweise nicht überleben würden.

Für Entwickler, die Claude Code verwenden, ist dies praktisch relevant. Das Verhalten des Tools spiegelt Trainingsprioritäten wider, die Sicherheit, Transparenz und verfassungsrechtliche Einschränkungen betonen. Ob diese Prioritäten mit dem Wachstum des Unternehmens bestehen bleiben, ist eine offene Frage – aber die Eigentümerstruktur schafft zumindest institutionelle Unterstützung für ihre Aufrechterhaltung.

Die Wettbewerbslandschaft: Claude Code vs. GitHub Copilot und Cursor

Claude Code konkurriert in einem überfüllten Markt für KI-Coding-Assistenten. GitHub Copilot gehört Microsoft (über seine Tochtergesellschaft GitHub). Cursor operiert als unabhängiges Startup. Jede Eigentümerstruktur beeinflusst die Produktentwicklung unterschiedlich.

Microsofts Besitz von Copilot bedeutet eine enge Integration mit Visual Studio Code, GitHub-Repositorys und dem breiteren Microsoft-Entwickler-Ökosystem. Diese Integration schafft Komfort, aber auch eine Bindung an die Plattformen von Microsoft.

Claude Codes terminalbasierter Ansatz und sein modellagnostisches Design spiegeln unterschiedliche Prioritäten wider. Das Tool funktioniert über Entwicklungsumgebungen hinweg, ohne dass spezifische IDE-Plugins oder Plattformbindungen erforderlich sind.

Diskussionen in der Community deuten auf eine starke Begeisterung der Entwickler für die Fähigkeiten von Claude Code hin. Laut WIRED sprach Boris Cherny, Leiter von Claude Code, darüber, wie das Tool die Entwicklungsworkflows verändert – eine bemerkenswerte Bestätigung der Reife der Technologie.

Zukunftsausblick: Börsengang-Spekulationen und ihre Bedeutung für die Eigentümerschaft

Laut Capital.com hat Anthropic im Dezember 2025 keinen Börsengang beantragt und keine öffentliche Erklärung abgegeben, die auf einen bevorstehenden Börsengang hindeutet.

Private Finanzierungsrunden Anfang 2025 bewerteten Anthropic mit 61,5 Milliarden US-Dollar. Die Serie G-Finanzierungsrunde im Februar 2026 bewertete das Unternehmen mit 380 Milliarden US-Dollar nach der Finanzierung, was sowohl die Dynamik des KI-Marktes als auch die spezifische Traktion von Anthropic widerspiegelt.

Ein Börsengang würde die Eigentümerstruktur von Anthropic grundlegend verändern. Öffentliche Marktinvestoren würden Anteile erwerben, was die Gründerbeteiligung möglicherweise weiter verwässern würde. Die Offenlegungspflichten eines börsennotierten Unternehmens würden Transparenz bei Finanzen, Kundenkennzahlen und operativen Details schaffen, die derzeit privat gehalten werden.

Ein Börsengang schafft aber auch Druck für Quartalsgewinnwachstum, der im Widerspruch zur langfristigen Sicherheitsforschung stehen kann. Die Spannung zwischen den Erwartungen des öffentlichen Marktes und den Prioritäten der KI-Sicherheit kann beeinflussen, ob und wann Anthropic einen Börsengang anstrebt.

Vorerst bleibt das Unternehmen privat mit verteilter Eigentümerschaft über Gründer, strategische Investoren und finanzielle Unterstützer – eine Struktur, die operative Unabhängigkeit bewahrt und gleichzeitig massives Kapital für die Modellentwicklung bereitstellt.

Häufig gestellte Fragen

Wem gehört Claude Code?

Claude Code gehört zu Anthropic, einer Public Benefit Corporation, die 2021 von sieben ehemaligen OpenAI-Forschern, darunter Dario Amodei (CEO) und Daniela Amodei (Präsidentin), gegründet wurde. Obwohl große Investoren wie Amazon und Google Milliarden an Finanzierung bereitgestellt haben, bleibt Anthropic unabhängig betrieben, wobei die Gründer im Januar 2025 jeweils bedeutende Anteile von 2 % oder mehr behalten.

Besitzen Amazon Claude oder Anthropic?

Nein, Amazon besitzt Claude oder Anthropic nicht. Amazon hat als bedeutender Investor mehrfach in Anthropic investiert und unterhält eine Partnerschaft für Cloud-Infrastruktur über AWS. Diese Investition stellt jedoch eine Minderheitsbeteiligung ohne Kontrollinteresse dar. Die verteilte Investorenbasis von Anthropic und die Struktur als Public Benefit Corporation verhindern, dass eine einzelne Entität die Eigentümerschaft kontrolliert.

Ist Claude Code Open Source?

Claude Code hat Open-Source-Komponenten unter der MIT-Lizenz, wie das Repository claude-code-security-review auf GitHub zeigt. Die zugrunde liegenden Claude-Modelle sind jedoch proprietär für Anthropic. Der Quellcode des Tools ist auf GitHub verfügbar, was eine erhebliche Beteiligung der Community demonstriert und Community-Beiträge sowie Transparenz über seine Funktionalität ermöglicht.

Wie verdient Anthropic Geld mit Claude Code?

Anthropic generiert Einnahmen durch API-Zugang zu Claude-Modellen, Enterprise-Lizenzierung für Tools wie Claude Code und spezialisierte Lösungen wie Claude for Financial Services, das im Juli 2025 eingeführt wurde. Laut der Serie G-Ankündigung vom Februar 2026 erreichte der Run-Rate-Umsatz von Anthropic 14 Milliarden US-Dollar, was in jedem der drei vorangegangenen Jahre eine Steigerung von über dem 10-fachen pro Jahr darstellt. Spezifische Preise variieren – prüfen Sie die offizielle Website von Anthropic für aktuelle kommerzielle Bedingungen.

Was ist eine Public Benefit Corporation und wie beeinflusst sie die Entwicklung von Claude?

Eine Public Benefit Corporation (PBC) ist eine Rechtsstruktur, die Unternehmen verpflichtet, Aktionärsrenditen mit breiterem gesellschaftlichem Nutzen in Einklang zu bringen. Anthropic's PBC-Status schafft rechtliche Verpflichtungen, KI-Sicherheit und öffentliche Auswirkungen neben dem Gewinn zu berücksichtigen – theoretisch beeinflusst dies Entscheidungen über Sicherheitsfunktionen, Transparenz und Zugangspolitik. Diese Struktur unterscheidet sich von Standard-Delaware-C-Corps, die sich hauptsächlich auf die Maximierung des Shareholder Value konzentrieren.

Können Google oder Microsoft Anthropic kaufen?

Obwohl technisch möglich, würde jede Akquisition die Zustimmung des Vorstands und der Aktionäre von Anthropic erfordern, einschließlich der sieben Mitgründer, die bedeutende Anteile behalten. Die Struktur als Public Benefit Corporation schafft auch zusätzliche Überlegungen über reine Finanzbedingungen hinaus. Ab Februar 2026 wurden keine Übernahmegespräche öffentlich bekannt gegeben, und Anthropic operiert weiterhin unabhängig, trotz großer Investitionen von Tech-Giganten.

Wer hat Claude AI erfunden?

Claude AI wurde von dem Team bei Anthropic entwickelt, angeführt von den Mitgründern Dario Amodei, Daniela Amodei, Tom Brown, Jack Clark, Jared Kaplan, Sam McCandlish und Christopher Olah. Das Modell baut auf Forschung auf, die diese Wissenschaftler bei OpenAI vor der Gründung von Anthropic im Jahr 2021 durchgeführt haben. Tom Brown war Co-Autor des GPT-3-Papers, und die kollektive Expertise des Teams in großen Sprachmodellen und KI-Sicherheit informierte den Entwicklungsansatz von Claude unter Verwendung von Constitutional AI-Methoden.

Was das alles für Entwickler und Unternehmen bedeutet

Das Verständnis, wer Claude Code besitzt, ist aus praktischen Gründen über Unternehmensintrigen hinaus wichtig. Die Eigentümerstruktur beeinflusst die Produkt-Roadmap, die Preisstabilität, die Datenverwaltung und die langfristige Lebensfähigkeit.

Anthropic's Unabhängigkeit bedeutet, dass das Unternehmen Produktentscheidungen treffen kann, ohne sich an das Ökosystem einer Muttergesellschaft anpassen zu müssen. Claude Code funktioniert plattformübergreifend, ohne spezifische Cloud-Anbieter oder Entwicklungsumgebungen zu bevorzugen – eine Flexibilität, die die Autonomie der Eigentümerschaft widerspiegelt.

Die verteilte Investorenbasis reduziert das Risiko plötzlicher strategischer Kurswechsel, die auftreten könnten, wenn eine einzelne Entität das Unternehmen kontrollieren würde. Wenn mehrere Großinvestoren Anteile halten, erfordern Produktentscheidungen einen breiteren Konsens, anstatt den Interessen einer Partei zu dienen.

Für Unternehmen, die KI-Coding-Tools bewerten, bieten Anthropic's Status als Public Benefit Corporation und der Constitutional AI-Ansatz eine Abgrenzung zu rein gewinnorientierten Wettbewerbern. Ob diese strukturellen Vorteile zu besseren Ergebnissen führen, hängt von der Ausführung ab – aber sie schaffen zumindest institutionelle Unterstützung für eine sicherheitsorientierte Entwicklung.

Das rasante Bewertungswachstum des Unternehmens von 61,5 Milliarden US-Dollar auf 380 Milliarden US-Dollar in etwa einem Jahr signalisiert sowohl Chance als auch Volatilität. Diese Entwicklung spiegelt die allgemeine Dynamik des KI-Marktes und die spezifische Akzeptanz von Anthropic bei Unternehmenskunden wider.

Schlussfolgerung: Unabhängige Eigentümerschaft in einer Ära der Tech-Giganten-Dominanz

Claude Code gehört zu Anthropic, nicht zu Amazon, Google, Microsoft oder einem anderen Tech-Giganten – trotz gegenteiliger Schlagzeilen. Die sieben Mitgründer, die 2021 OpenAI verließen, behalten über die Public Benefit Corporation-Struktur von Anthropic bedeutende Beteiligungen und operative Kontrolle.

Große Investoren stellen Kapital und Infrastrukturpartnerschaften zur Verfügung, ohne die Produktrichtung vorzugeben. Dieses Gleichgewicht zwischen Unabhängigkeit und strategischer Unterstützung hat eine rasante Entwicklung vom Startup zur Bewertung von 380 Milliarden US-Dollar in weniger als fünf Jahren ermöglicht.

Die Eigentümerstruktur ist wichtig, da sie die Entwicklung von Claude Code prägt. Constitutional AI-Training, Transparenz über Fähigkeiten und Grenzen sowie die Berücksichtigung von Sicherheitsbedenken spiegeln Prioritäten wider, die in einem typischen, rein auf Wachstumskennzahlen ausgerichteten Unternehmen möglicherweise nicht überleben würden.

Für Entwickler und Unternehmen stellt Claude Code damit eine wirklich unabhängige Alternative zu Tools dar, die von großen Tech-Plattformen besessen werden. Ob diese Unabhängigkeit mit zunehmender Skalierung des Unternehmens, IPO-Druck oder der Bewältigung von Wettbewerbsbedrohungen bestehen bleibt, ist ungewiss.

Aber Stand März 2026 behält Anthropic die Kontrolle über Claude Code durch eine Struktur, die darauf ausgelegt ist, kommerziellen Erfolg mit breiteren Überlegungen zur KI-Sicherheit in Einklang zu bringen. Das ist im heutigen Tech-Umfeld selten genug, um es wert zu sein, verstanden und aufmerksam beobachtet zu werden, während die Technologie die Art und Weise, wie wir Software erstellen, weiter verändert.

Möchten Sie Claude Code für Ihren Entwicklungs-Workflow erkunden? Besuchen Sie die offizielle Website von Anthropic für aktuelle Zugangsmöglichkeiten, Preise und Dokumentation. Die Eigentümerschaft mag komplex sein, aber das Tool selbst ist auf Einfachheit ausgelegt – Befehle in natürlicher Sprache in Ihrem Terminal, angetrieben von Modellen, die von Anfang an mit Sicherheitsbeschränkungen trainiert wurden.