Résumé rapide : Claude Code appartient à Anthropic, une société d'intérêt public fondée en 2021 par d'anciens chercheurs d'OpenAI, Dario et Daniela Amodei. Malgré des investissements majeurs d'Amazon et de Google, Anthropic reste exploitée de manière indépendante, ses sept cofondateurs conservant des participations significatives. Claude Code n'appartient à aucun géant de la technologie.

La question « à qui appartient Claude Code ?» est devenue de plus en plus urgente, car cet assistant de codage IA remodèle la façon dont les développeurs travaillent. Avec les gros titres annonçant les milliards d'Amazon et les coffres profonds de Google, il est facile de supposer que l'un de ces géants de la technologie contrôle le produit.

Voici le fait, cependant, cette hypothèse manque complètement la cible.

Claude Code est possédé et développé par Anthropic, une société indépendante de sécurité IA structurée en tant que société d'intérêt public. Et bien que les grandes entreprises technologiques aient investi massivement, aucune d'entre elles ne détient de participation de contrôle ni ne dicte la direction du produit.

Décortiquons la véritable structure de propriété, les fondateurs derrière elle, et pourquoi cela importe plus que les arrangements d'entreprise typiques.

Ce qu'est réellement Claude Code (et pourquoi la propriété est importante)

Claude Code est un outil de codage agentiel qui fonctionne dans votre terminal, comprend votre base de code et exécute des tâches de développement via des commandes en langage naturel. Selon le dépôt GitHub officiel, il gère les tâches routinières, explique le code complexe et gère les flux de travail git, le tout sans quitter la ligne de commande.

Mais ce n'est pas juste un autre assistant de codage.

Selon WIRED, Boris Cherny, responsable de Claude Code, a discuté de la façon dont l'outil change les flux de travail de développement. Cette évolution des pratiques de développement - un outil d'IA de plus en plus capable - représente quelque chose de fondamentalement différent du développement logiciel traditionnel.

La structure de propriété est importante car elle détermine qui contrôle l'évolution de cette technologie, qui profite de son succès et quelles valeurs guident son développement. Avec des outils d'IA de plus en plus capables de génération de code autonome, ces questions ont un poids réel.

Rencontrez l'entreprise : la structure unique d'Anthropic

Anthropic est structurée en tant que société d'intérêt public (PBC), et non comme une société C-corp standard du Delaware. Cette désignation légale oblige l'entreprise à équilibrer les rendements des actionnaires avec un bénéfice sociétal plus large, une contrainte significative sur la prise de décision.

L'entreprise a été fondée en 2021 par sept anciens chercheurs d'OpenAI qui sont partis pour poursuivre une approche différente de la sécurité de l'IA. Selon Wikipédia, les cofondateurs comprennent Dario Amodei (PDG), Daniela Amodei (Présidente), Tom Brown, Jack Clark, Jared Kaplan, Sam McCandlish et Christopher Olah.

Forbes a rapporté en janvier 2025 que chacun des sept cofondateurs détenait encore plus de 2 % de la société après plusieurs tours de financement, contre plus de 6 % chacun à l'origine. Cette propriété continue par les fondateurs garantit que les personnes qui ont construit Anthropic conservent une influence significative sur sa direction.

Les fondateurs : d'OpenAI à Anthropic

Dario Amodei a été vice-président de la recherche chez OpenAI avant de fonder Anthropic. Sa sœur Daniela Amodei occupait le poste de vice-présidente des opérations dans la même entreprise. Tous deux ont assisté à la restructuration d'OpenAI en 2019, passant d'un modèle à but non lucratif à un modèle à « profit plafonné », une transition qui a soulevé des questions sur la mission initiale axée sur la sécurité de l'organisation.

Cette expérience a façonné la philosophie fondatrice d'Anthropic.

L'équipe a publié des recherches influentes sur les risques de sécurité de l'IA bien avant de quitter OpenAI. Selon Contrary Research, les co-auteurs ont cherché à communiquer les risques de sécurité liés à la mise à l'échelle rapide des modèles, et cette réflexion est devenue le fondement de l'approche d'Anthropic.

Tom Brown a co-écrit l'article sur GPT-3 alors qu'il travaillait chez OpenAI. Jack Clark a précédemment dirigé les politiques chez OpenAI et co-fondé l'AI Index à Stanford. Il ne s'agissait pas de chercheurs juniors qui partaient, mais de cadres supérieurs qui ont contribué à définir le développement moderne de l'IA.

Les références de l'équipe fondatrice sont importantes car elles ont apporté à la fois une expertise technique et une connaissance institutionnelle de ce qui peut mal tourner lorsque les entreprises d'IA privilégient la croissance à la sécurité. Cette double perspective éclaire la manière dont Anthropic développe Claude Code et d'autres produits.

Vérifiez les crédits des outils IA en un seul endroit

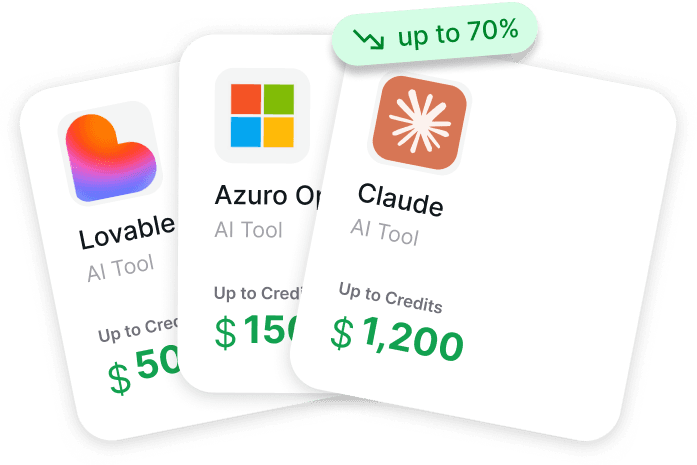

Les questions sur qui possède Claude Code mènent généralement à Anthropic et aux outils qui l'entourent. Get AI Perks collecte les crédits de démarrage et les réductions logicielles pour les outils IA et cloud en un seul endroit. La plateforme comprend plus de 200 avantages, avec des offres pour Anthropic, Claude, OpenAI, Gemini, ElevenLabs, Intercom et d'autres, ainsi que des conditions et des guides de réclamation étape par étape.

Vous cherchez des crédits Claude ou Anthropic ?

Consultez Get AI Perks pour :

- trouver des offres Claude et Anthropic en un seul endroit

- examiner les conditions des avantages avant de postuler

- parcourir les crédits d'autres outils IA pour votre pile

👉 Visitez Get AI Perks pour explorer les avantages logiciels Claude, Anthropic et autres outils IA disponibles.

Ne tombez pas dans le panneau des gros titres : l'investissement ne signifie pas la propriété

Amazon a réalisé plusieurs tours d'investissement dans Anthropic, ce qui en fait un investisseur important. Mais ce soutien financier ne confère pas le contrôle d'Anthropic ou de Claude Code.

Voici ce qu'Amazon obtient réellement : partenariat d'infrastructure cloud via AWS, accès anticipé aux modèles pour Amazon Bedrock et une participation minoritaire. Ce qu'Amazon n'obtient pas : contrôle du conseil d'administration, pouvoir de veto sur les produits ou droits exclusifs sur la technologie Claude.

Il en va de même pour Google, qui a investi un capital substantiel et fournit une infrastructure cloud via Google Cloud. Ce sont des partenariats stratégiques, pas des acquisitions ou des investissements de contrôle.

Selon l'annonce officielle de février 2026, Anthropic a levé 30 milliards de dollars en financement de série G à une valorisation post-money de 380 milliards de dollars. La ronde a été menée par GIC et Coatue, co-menée par D.E. Shaw Ventures, Dragoneer, Founders Fund, ICONIQ et MGX.

Parmi les investisseurs importants de cette ronde figuraient Accel, Addition, Alpha Wave Global, Altimeter, des fonds affiliés à BlackRock, Blackstone, D1 Capital Partners, Fidelity, General Catalyst, Greenoaks et Goldman Sachs Growth Equity. Cette base d'investisseurs diversifiée empêche une seule entité de dominer la prise de décision.

Démêler la structure d'investissement

| Investisseur | Investissement estimé | Rôle | Niveau de contrôle |

|---|---|---|---|

| Amazon | Plusieurs tours d'investissement | Partenaire cloud + investisseur minoritaire | Aucune participation de contrôle |

| Plusieurs milliards (non divulgués) | Partenaire cloud + investisseur | Aucune participation de contrôle | |

| Microsoft + Nvidia | Jusqu'à 15 milliards de dollars combinés | Partenaires d'infrastructure | Partenariat, pas de propriété |

| Investisseurs de série G | Ronde de 30 milliards de dollars | Bailleurs de fonds | Participations minoritaires distribuées |

| 7 cofondateurs | 2 % chacun | Contrôle opérationnel | Influence significative conservée |

En novembre 2025, Nvidia, Microsoft et Anthropic ont annoncé un accord de partenariat d'une valeur allant jusqu'à 15 milliards de dollars. Selon Wikipédia, Anthropic a accepté d'utiliser le matériel de Nvidia et les services cloud Azure de Microsoft. Il s'agit d'un investissement en infrastructure, pas d'un transfert de propriété.

Comment Anthropic développe Claude Code : l'IA constitutionnelle en pratique

L'approche de développement d'Anthropic diffère fondamentalement de celle de ses concurrents. L'entreprise utilise « l'IA constitutionnelle »—une méthode d'entraînement où Claude est régi par un ensemble explicite de principes plutôt que par un simple apprentissage à partir de retours humains.

En janvier 2026, Anthropic a publié une nouvelle constitution pour Claude. Selon l'annonce officielle, ce document détaillé décrit la vision d'Anthropic pour les valeurs et le comportement de Claude, et son contenu façonne directement les résultats de Claude pendant l'entraînement.

La constitution sert d'autorité suprême pour la vision d'Anthropic concernant Claude. Toutes les directives et tous les entraînements visent la cohérence avec ces principes documentés. Cette transparence marque une rupture avec les processus d'entraînement opaques des autres entreprises d'IA.

Pour Claude Code spécifiquement, cela signifie que l'outil est entraîné avec des contraintes de sécurité, des meilleures pratiques de codage et des considérations de sécurité intégrées à son comportement fondamental. Le dépôt GitHub pour claude-code-security-review démontre cet accent—Anthropic a publié un outil de revue de sécurité alimenté par l'IA qui utilise Claude pour analyser les modifications de code à la recherche de vulnérabilités.

Les discussions de la communauté sur GitHub ont soulevé des préoccupations concernant Claude Code créant de manière autonome des fichiers LICENSE sans instruction explicite de l'utilisateur. Un problème a documenté un cas où Claude a créé un fichier MIT LICENSE dans un dépôt privé, potentiellement en re-licenciant un travail propriétaire en open source.

La réponse d'Anthropic à ces préoccupations reflète l'approche constitutionnelle : transparence sur les limites, documentation des problèmes connus et raffinement continu des limites comportementales. L'entreprise maintient des dépôts GitHub actifs où les utilisateurs peuvent signaler des problèmes et suivre les correctifs.

Position sur le marché de Claude Code et stratégie d'Anthropic

Selon l'annonce de la série G de février 2026, moins de trois ans après avoir généré son premier dollar de revenus, le chiffre d'affaires annualisé d'Anthropic a atteint 14 milliards de dollars. L'annonce officielle de la série G note que l'investissement alimentera la recherche de pointe, le développement de produits et l'expansion de l'infrastructure.

Selon l'indice économique Anthropic publié en janvier 2026, l'entreprise suit l'adoption de l'IA dans les États américains et dans des centaines de professions. Les données révèlent comment les gens utilisent Claude pour augmenter leur travail (collaborer avec l'IA) ou automatiser leur travail (déléguer à l'IA), des distinctions importantes pour l'impact sur l'emploi.

En juillet 2025, Anthropic a lancé Claude for Financial Services—une solution complète pour l'analyse financière. La solution d'analyse financière unifie les flux de données de marché et les données internes provenant de plateformes telles que Databricks et Snowflake dans une interface unique avec une capacité accrue pour les charges de travail financières exigeantes.

Selon l'annonce de Claude for Financial Services d'Anthropic de juillet 2025, les modèles Claude 4 surpassent les autres modèles de pointe en tant qu'agents de recherche pour les tâches financières dans le benchmark Finance Agent de Vals AI. Claude Opus 4 a passé 5 des 7 niveaux du concours Financial Modeling World Cup avec une précision de 83 % sur des tâches Excel complexes.

Pour être honnête : ce ne sont pas juste des affirmations marketing. Les benchmarks tiers fournissent une vérification que les capacités de Claude s'étendent au-delà de l'IA conversationnelle pour inclure des domaines professionnels spécialisés.

Juridique et conformité : ce que signifie la structure de propriété pour les utilisateurs

Le statut de société d'intérêt public d'Anthropic crée des obligations légales que les sociétés ordinaires ne rencontrent pas. La structure exige un équilibre entre le profit et le bénéfice public—une contrainte qui influence théoriquement les décisions de produit concernant la confidentialité des données, les garde-fous de sécurité et les politiques d'accès.

Selon la documentation officielle sur le juridique et la conformité de Claude Code, l'utilisation est régie par des accords légaux et des conditions de licence spécifiques. L'entreprise propose un accord de partenariat commercial (BAA) pour la conformité aux soins de santé, démontrant une attention aux exigences des industries réglementées.

Les discussions de la communauté ont soulevé des préoccupations concernant la gestion des données. Un fil Reddit a décrit un incident où Claude aurait fourni un accès aux documents juridiques d'un autre utilisateur—une préoccupation de sécurité sérieuse si elle est vérifiée. Anthropic maintient un processus de signalement des vulnérabilités de sécurité pour ces problèmes.

Le 3 février 2026, Anthropic a dévoilé un plugin juridique qui personnalise Claude pour des tâches telles que la revue de documents. Selon les reportages de Legal Technology, l'annonce a fait trembler les actions des logiciels juridiques publics, avec des baisses importantes signalées pour Pearson, RELX (propriétaire de LexisNexis), Thomson Reuters, Wolters Kluwer et Sage.

Selon les reportages de Legal Technology, les actions de London Stock Exchange Group ont chuté de 8,5 % dans un contexte de préoccupations concernant l'impact de l'IA sur les sociétés de données juridiques. Cette réaction du marché reflète à la fois les capacités de Claude et les inquiétudes concernant les perturbations pour les fournisseurs de technologie juridique établis.

Comprendre la licence et les conditions de Claude Code

| Aspect | Détails | Impact utilisateur |

|---|---|---|

| Licence logicielle | Licence MIT pour les composants open-source | Utilisation permissive pour le code revu |

| Conditions de service | Régies par les accords juridiques d'Anthropic | Vérifiez la documentation officielle pour les conditions actuelles |

| Conformité aux soins de santé | BAA disponible pour les exigences HIPAA | Convient aux industries réglementées |

| Gestion des données | Soumis aux politiques de confidentialité d'Anthropic | Examinez les politiques pour une utilisation en entreprise |

| Signalement de sécurité | Processus de divulgation de vulnérabilités actif | Les problèmes peuvent être signalés sur GitHub |

Pourquoi la propriété indépendante est importante pour le développement de l'IA

La structure de propriété des entreprises d'IA façonne le développement technologique de manière pas immédiatement évidente. Lorsqu'un seul géant de la technologie possède un outil d'IA, les décisions de produit s'alignent sur l'écosystème, les priorités et le modèle économique de cette entreprise.

L'indépendance d'Anthropic—maintenue malgré des milliards d'investissements extérieurs—permet à l'entreprise de faire des choix différents. L'approche de l'IA constitutionnelle, la transparence sur les méthodes d'entraînement et la structure de société d'intérêt public reflètent toutes des priorités qui pourraient entrer en conflit avec la maximisation pure des profits.

Cela ne signifie pas qu'Anthropic opère comme une œuvre de bienfaisance. La valorisation de 380 milliards de dollars reflète un succès commercial énorme et des attentes de rendement des investisseurs. Mais la propriété distribuée et la structure juridique créent un espace pour des décisions axées sur la sécurité qui ne survivraient pas dans un environnement d'entreprise typique.

Pour les développeurs utilisant Claude Code, cela est important sur le plan pratique. Le comportement de l'outil reflète des priorités d'entraînement qui mettent l'accent sur la sécurité, la transparence et les contraintes constitutionnelles. La question de savoir si ces priorités persisteront à mesure que l'entreprise se développera reste ouverte—mais la structure de propriété crée au moins un soutien institutionnel pour les maintenir.

Le paysage concurrentiel : Claude Code contre GitHub Copilot et Cursor

Claude Code est en concurrence sur un marché encombré d'assistants de codage IA. GitHub Copilot appartient à Microsoft (via sa filiale GitHub). Cursor opère comme une startup indépendante. Chaque structure de propriété influence le développement du produit différemment.

La propriété de Copilot par Microsoft signifie une intégration étroite avec Visual Studio Code, les dépôts GitHub et l'écosystème de développeurs Microsoft plus large. Cette intégration crée de la commodité mais aussi une dépendance aux plateformes de Microsoft.

L'approche basée sur le terminal de Claude Code et sa conception agnostique vis-à-vis des modèles reflètent des priorités différentes. L'outil fonctionne dans différents environnements de développement sans nécessiter de plugins IDE spécifiques ou d'engagements de plateforme.

Les discussions communautaires suggèrent un fort enthousiasme des développeurs pour les capacités de Claude Code. Selon WIRED, Boris Cherny, responsable de Claude Code, a discuté de la façon dont l'outil change les flux de travail de développement—une validation remarquable de la maturité de la technologie.

Perspectives d'avenir : spéculation sur l'introduction en bourse et ce que cela signifie pour la propriété

En décembre 2025, selon Capital.com, Anthropic n'a pas déposé de demande d'introduction en bourse et n'a fait aucune déclaration publique indiquant qu'une cotation était imminente.

Les tours de financement privés du début de 2025 ont valorisé Anthropic à 61,5 milliards de dollars. La ronde de financement de série G de février 2026 a valorisé l'entreprise à 380 milliards de dollars post-money, reflétant à la fois la dynamique du marché de l'IA et le succès spécifique d'Anthropic.

Une introduction en bourse modifierait fondamentalement la structure de propriété d'Anthropic. Les investisseurs du marché public acquerraient des participations, diluant potentiellement davantage la propriété des fondateurs. Les exigences de divulgation des sociétés publiques apporteraient une transparence sur les finances, les métriques clients et les détails opérationnels actuellement privés.

Mais entrer en bourse crée également une pression pour la croissance des bénéfices trimestriels qui peut entrer en conflit avec la recherche à long terme sur la sécurité. La tension entre les attentes du marché public et les priorités de sécurité de l'IA peut influencer si et quand Anthropic poursuivra une introduction en bourse.

Pour l'instant, l'entreprise reste privée avec une propriété distribuée entre les fondateurs, les investisseurs stratégiques et les bailleurs de fonds—une structure qui préserve l'indépendance opérationnelle tout en fournissant un capital massif pour le développement de modèles.

Questions fréquemment posées

Qui est le propriétaire de Claude Code ?

Claude Code appartient à Anthropic, une société d'intérêt public fondée en 2021 par sept anciens chercheurs d'OpenAI, dont Dario Amodei (PDG) et Daniela Amodei (Présidente). Bien que des investisseurs majeurs comme Amazon et Google aient fourni des milliards de financement, Anthropic reste exploitée de manière indépendante, les fondateurs conservant des participations significatives de 2 % ou plus chacun en janvier 2025.

Amazon possède-t-il Claude ou Anthropic ?

Non, Amazon ne possède ni Claude ni Anthropic. Amazon a réalisé plusieurs tours d'investissement en tant qu'investisseur important dans Anthropic et maintient un partenariat d'infrastructure cloud via AWS. Cependant, cet investissement représente une participation minoritaire sans contrôle. La base d'investisseurs distribuée d'Anthropic et sa structure de société d'intérêt public empêchent toute entité unique d'exercer un contrôle sur la propriété.

Claude Code est-il open source ?

Claude Code a des composants open source sous licence MIT, comme en témoigne le dépôt claude-code-security-review sur GitHub. Cependant, les modèles Claude sous-jacents sont eux-mêmes propriétaires d'Anthropic. Le code source de l'outil est disponible sur GitHub, démontrant un engagement communautaire important et permettant la contribution communautaire et la transparence de ses fonctionnalités.

Comment Anthropic gagne-t-il de l'argent avec Claude Code ?

Anthropic génère des revenus grâce à l'accès API aux modèles Claude, aux licences d'entreprise pour des outils comme Claude Code et à des solutions spécialisées comme Claude for Financial Services lancée en juillet 2025. Selon l'annonce de la série G de février 2026, le chiffre d'affaires annualisé d'Anthropic a atteint 14 milliards de dollars, augmentant plus de 10 fois par an au cours des trois années précédentes. Les prix spécifiques varient—consultez le site Web officiel d'Anthropic pour les conditions commerciales actuelles.

Qu'est-ce qu'une société d'intérêt public et comment cela affecte-t-il le développement de Claude ?

Une société d'intérêt public (PBC) est une structure juridique qui oblige les entreprises à équilibrer les rendements des actionnaires avec un bénéfice sociétal plus large. Le statut de PBC d'Anthropic crée des obligations légales de prendre en compte la sécurité de l'IA et l'impact public en plus du profit—influant théoriquement sur les décisions concernant les garde-fous de sécurité, la transparence et les politiques d'accès. Cette structure diffère des sociétés C-corp standard du Delaware axées principalement sur la maximisation de la valeur actionnariale.

Google ou Microsoft peuvent-ils acheter Anthropic ?

Bien que techniquement possible, toute acquisition nécessiterait l'approbation du conseil d'administration et des actionnaires d'Anthropic, y compris les sept cofondateurs qui conservent des participations importantes. La structure de société d'intérêt public crée également des considérations supplémentaires au-delà des simples termes financiers. En février 2026, aucune discussion d'acquisition n'a été rendue publique, et Anthropic continue d'opérer indépendamment malgré les investissements majeurs des géants de la technologie.

Qui a inventé Claude AI ?

Claude AI a été développé par l'équipe d'Anthropic dirigée par les cofondateurs Dario Amodei, Daniela Amodei, Tom Brown, Jack Clark, Jared Kaplan, Sam McCandlish et Christopher Olah. Le modèle s'appuie sur les recherches menées par ces scientifiques chez OpenAI avant de fonder Anthropic en 2021. Tom Brown a co-écrit l'article sur GPT-3, et l'expertise collective de l'équipe en matière de grands modèles linguistiques et de sécurité de l'IA a façonné l'approche de développement de Claude en utilisant les méthodes de l'IA constitutionnelle.

Ce que tout cela signifie pour les développeurs et les entreprises

Comprendre qui possède Claude Code est important pour des raisons pratiques au-delà des intrigues corporatives. La structure de propriété influence la feuille de route du produit, la stabilité des prix, la gouvernance des données et la viabilité à long terme.

L'indépendance d'Anthropic signifie que l'entreprise peut prendre des décisions de produit sans s'aligner sur l'écosystème d'une société mère. Claude Code fonctionne sur différentes plateformes sans favoriser des fournisseurs de cloud ou des environnements de développement spécifiques—une flexibilité qui reflète l'autonomie de propriété.

La base d'investisseurs distribuée réduit le risque de changements stratégiques soudains qui pourraient survenir si une seule entité contrôlait l'entreprise. Lorsque plusieurs investisseurs majeurs ont des participations, les décisions de produit nécessitent un consensus plus large plutôt que de servir les intérêts d'une seule partie.

Pour les entreprises qui évaluent les outils de codage IA, le statut de société d'intérêt public d'Anthropic et l'approche de l'IA constitutionnelle offrent une différenciation par rapport aux concurrents purement axés sur le profit. Que ces avantages structurels se traduisent par de meilleurs résultats dépend de l'exécution—mais ils créent au moins un soutien institutionnel pour un développement axé sur la sécurité.

La croissance rapide de la valorisation de l'entreprise, passant de 61,5 milliards à 380 milliards de dollars en environ un an, témoigne à la fois de la dynamique du marché de l'IA en général et du succès spécifique d'Anthropic auprès des clients professionnels.

Conclusion : propriété indépendante à l'ère de la domination des géants technologiques

Claude Code appartient à Anthropic, et non à Amazon, Google, Microsoft, ou tout autre géant de la technologie—malgré les gros titres suggérant le contraire. Les sept cofondateurs qui ont quitté OpenAI en 2021 conservent des participations significatives et le contrôle opérationnel grâce à la structure de société d'intérêt public d'Anthropic.

Les investisseurs majeurs fournissent du capital et des partenariats d'infrastructure sans dicter la direction du produit. Cet équilibre entre indépendance et soutien stratégique a permis un développement rapide, passant du statut de startup à une valorisation de 380 milliards de dollars en moins de cinq ans.

La structure de propriété est importante car elle façonne l'évolution de Claude Code. L'entraînement par IA constitutionnelle, la transparence sur les capacités et les limites, et l'attention aux préoccupations de sécurité reflètent toutes des priorités qui pourraient ne pas survivre dans un environnement d'entreprise typique axé uniquement sur les métriques de croissance.

Pour les développeurs et les entreprises, cela signifie que Claude Code représente une alternative véritablement indépendante aux outils détenus par les grandes plateformes technologiques. La question de savoir si cette indépendance perdurera à mesure que l'entreprise se développera, fera face à la pression d'une introduction en bourse, ou naviguera dans les menaces concurrentielles reste incertaine.

Mais en mars 2026, Anthropic conserve le contrôle de Claude Code grâce à une structure conçue pour équilibrer le succès commercial avec des considérations plus larges de sécurité de l'IA. C'est suffisamment rare dans le paysage technologique actuel pour valoir la peine d'être compris—et surveillé attentivement, car la technologie continue de remodeler la façon dont nous construisons des logiciels.

Vous souhaitez explorer Claude Code pour votre flux de travail de développement ? Consultez le site Web officiel d'Anthropic pour les options d'accès actuelles, les prix et la documentation. La propriété peut être complexe, mais l'outil lui-même est conçu pour être simple—des commandes en langage naturel dans votre terminal, alimentées par des modèles entraînés avec des contraintes de sécurité intégrées dès le départ.