Kort oppsummering: Claude Code eies av Anthropic, et selskap med samfunnsformål stiftet i 2021 av tidligere OpenAI-forskere Dario og Daniela Amodei. Til tross for store investeringer fra Amazon og Google, forblir Anthropic uavhengig drevet med sine syv medgründere som beholder betydelige eierandeler. Claude Code eies ikke av noen enkelt teknologigigant.

Spørsmålet «hvem eier Claude Code?» har blitt stadig mer presserende ettersom denne AI-kodeassistenten omformer måten utviklere jobber på. Med overskrifter som skriker om Amazons milliarder og Googles dype lommer, er det lett å anta at en av disse teknologigigantene kontrollerer produktet.

Saken er imidlertid at denne antagelsen bommer fullstendig.

Claude Code eies og utvikles av Anthropic, et uavhengig AI-sikkerhetsselskap strukturert som et selskap med samfunnsformål. Og selv om store teknologiselskaper har investert tungt, eier ingen av dem kontrollerende andeler eller dikterer produktretningen.

La oss se nærmere på den virkelige eierstrukturen, grunnleggerne bak den, og hvorfor dette er viktigere enn typiske bedriftsordninger.

Hva Claude Code Egentlig Er (Og Hvorfor Eierskap Betyr Noe)

Claude Code er et agentbasert kodingsverktøy som opererer i terminalen din, forstår kodestedet ditt og utfører utviklingsoppgaver gjennom naturlige språkkommandoer. Ifølge det offisielle GitHub-arkivet, håndterer det rutinemessige oppgaver, forklarer kompleks kode og administrerer git-arbeidsflyter – alt uten å forlate kommandolinjen.

Men dette er ikke bare en ny kodeassistent.

Ifølge WIRED, diskuterte Boris Cherny, leder for Claude Code, hvordan verktøyet endrer utviklingsarbeidsflyter. Den utviklingen i utviklingspraksis – et AI-verktøy som blir stadig mer kapabelt – representerer noe fundamentalt annerledes enn tradisjonell programvareutvikling.

Eierstrukturen er viktig fordi den bestemmer hvem som kontrollerer denne teknologiss utvikling, hvem som tjener på suksessen, og hvilke verdier som styrer utviklingen. Med AI-verktøy som stadig blir mer kapable til autonom kodegenerering, bærer disse spørsmålene reell vekt.

Møt Selskapet: Anthropic's Unike Struktur

Anthropic er strukturert som et selskap med samfunnsformål (PBC), ikke en standard Delaware C-corp. Den juridiske betegnelsen krever at selskapet balanserer aksjonæravkastning med bredere samfunnsnytte – en meningsfull begrensning på beslutningstaking.

Selskapet ble grunnlagt i 2021 av syv tidligere OpenAI-forskere som forlot selskapet for å forfølge en annen tilnærming til AI-sikkerhet. Ifølge Wikipedia, inkluderer medgrunnleggerne Dario Amodei (administrerende direktør), Daniela Amodei (styreleder), Tom Brown, Jack Clark, Jared Kaplan, Sam McCandlish og Christopher Olah.

Forbes rapporterte i januar 2025 at hver av de syv medgrunnleggerne fortsatt eide mer enn 2% av selskapet etter flere finansieringsrunder, ned fra mer enn 6% hver ved oppstart. Den fortsatte eierandelen fra grunnleggerne sikrer at personene som bygde Anthropic, beholder betydelig innflytelse over retningen.

Grunnleggerne: Fra OpenAI til Anthropic

Dario Amodei var forskningssjef ved OpenAI før han grunnla Anthropic. Hans søster Daniela Amodei hadde rollen som driftsdirektør ved samme selskap. Begge var vitne til OpenAI's omstrukturering i 2019 fra en ideell organisasjon til en «capped-profit»-modell – en overgang som reiste spørsmål om organisasjonens opprinnelige sikkerhetsfokuserte misjon.

Den erfaringen formet Anthropic's grunnleggende filosofi.

Teamet publiserte innflytelsesrik forskning på AI-sikkerhetsrisiko lenge før de forlot OpenAI. Ifølge Contrary Research, søkte medforfatterne å kommunisere sikkerhetsrisikoene ved raskt skalerte modeller, og den tankegangen ble grunnlaget for Anthropic's tilnærming.

Tom Brown var medforfatter av GPT-3-papiret mens han var hos OpenAI. Jack Clark ledet tidligere politikk hos OpenAI og var medgrunnlegger av AI Index ved Stanford. Dette var ikke juniorforskere som hoppet av – de var seniorledere som bidro til å definere moderne AI-utvikling.

Grunnleggerteamets kvalifikasjoner betyr noe fordi de brakte både teknisk ekspertise og institusjonell kunnskap om hva som kan gå galt når AI-selskaper prioriterer vekst over sikkerhet. Det doble perspektivet informerer hvordan Anthropic utvikler Claude Code og andre produkter.

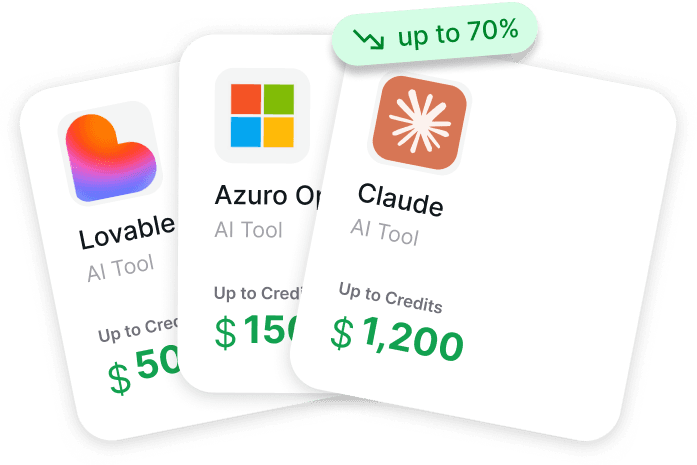

Sjekk AI-verktøy-kreditter Ett Sted

Spørsmål om hvem som eier Claude Code fører vanligvis tilbake til Anthropic og verktøyene rundt det. Get AI Perks samler opp startup-kreditter og rabatter på programvare for AI- og skyverktøy på ett sted. Plattformen inkluderer over 200 fordeler, med tilbud for Anthropic, Claude, OpenAI, Gemini, ElevenLabs, Intercom og andre, pluss betingelser og trinnvise veiledninger for krav.

Leter du etter Claude eller Anthropic-kreditter?

Sjekk Get AI Perks for å:

- finne Claude- og Anthropic-tilbud på ett sted

- gjennomgå fordelsvilkår før du søker

- bla gjennom andre AI-verktøykreditter for din stabel

👉 Besøk Get AI Perks for å utforske tilgjengelige Claude-, Anthropic- og andre AI-programvarefordeler.

Ikke Gå På Liming For Overskriftene: Investering Betyr Ikke Eierskap

Amazon har gjort flere investeringsrunder i Anthropic, noe som gjør dem til en betydelig investor. Men den økonomiske støtten gir ikke kontroll over Anthropic eller Claude Code.

Her er hva Amazon faktisk får: et skyinfrastrukturpartnerskap gjennom AWS, tidlig tilgang til modeller for Amazon Bedrock, og en minoritets aksjeandel. Hva Amazon ikke får: styrekontroll, veto-makt over produktet, eller eksklusive rettigheter til Claude-teknologi.

Det samme gjelder for Google, som investerte betydelig kapital og leverer skyinfrastruktur gjennom Google Cloud. Dette er strategiske partnerskap, ikke oppkjøp eller kontrollerende investeringer.

Ifølge den offisielle kunngjøringen fra februar 2026, hentet Anthropic 30 milliarder dollar i Serie G-finansiering til en verdsettelse etter finansiering på 380 milliarder dollar. Runden ble ledet av GIC og Coatue, og medledet av D.E. Shaw Ventures, Dragoneer, Founders Fund, ICONIQ og MGX.

Betydelige investorer i den runden inkluderte Accel, Addition, Alpha Wave Global, Altimeter, fond tilknyttet BlackRock, Blackstone, D1 Capital Partners, Fidelity, General Catalyst, Greenoaks og Goldman Sachs Growth Equity. Den mangfoldige investorgruppen forhindrer at noen enkelt enhet dominerer beslutningstakingen.

Nedbrytning av Investeringsstrukturen

| Investor | Estimert Investering | Rolle | Kontrollnivå |

|---|---|---|---|

| Amazon | Flere investeringsrunder | Skypartner + minoritetsinvestor | Ingen kontrollerende andel |

| Flere milliarder (ikke oppgitt) | Skypartner + investor | Ingen kontrollerende andel | |

| Microsoft + Nvidia | Opptil 15 milliarder dollar samlet | Infrastrukturpartnere | Partnerskap, ikke eierskap |

| Serie G Investorer | 30 milliarder dollar runde | Finansielle støttespillere | Distribuerte minoritetsandeler |

| 7 Medgründere | 2%+ hver | Operasjonell kontroll | Betydelig innflytelse beholdt |

I november 2025 kunngjorde Nvidia, Microsoft og Anthropic en partnerskapsavtale verdt opptil 15 milliarder dollar. Ifølge Wikipedia, ble Anthropic enig om å bruke Nvidias maskinvare og Microsofts Azure skytjenester. Dette er infrastrukturinvestering, ikke en overføring av eierskap.

Hvordan Anthropic Utvikler Claude Code: Constitutional AI i Praksis

Anthropic's utviklingstilnærming skiller seg fundamentalt fra konkurrenter. Selskapet bruker «Constitutional AI» – en treningsmetode der Claude styres av et eksplisitt sett med prinsipper snarere enn å utelukkende lære fra menneskelig tilbakemelding.

I januar 2026 publiserte Anthropic en ny grunnlov for Claude. Ifølge den offisielle kunngjøringen, beskriver dette detaljerte dokumentet Anthropic's visjon for Claude's verdier og oppførsel, og innholdet former direkte Claude's resultater under trening.

Grunnloven fungerer som den endelige autoriteten for Anthropic's visjon for Claude. All veiledning og trening sikter mot konsistens med disse dokumenterte prinsippene. Den transparensen markerer et brudd med uigjennomsiktige treningsprosesser hos andre AI-selskaper.

For Claude Code spesifikt, betyr dette at verktøyet er trent med sikkerhetsbegrensninger, beste praksis for koding og sikkerhetshensyn bakt inn i sin grunnleggende oppførsel. GitHub-arkivet for claude-code-security-review demonstrerer dette fokuset – Anthropic lanserte et AI-drevet sikkerhetsgjennomgangsverktøy som bruker Claude til å analysere kodeendringer for sårbarheter.

Felleskapsdiskusjoner på GitHub har reist bekymringer om at Claude Code autonomt oppretter LICENSE-filer uten eksplisitt brukerinstruksjon. En sak dokumenterte et tilfelle der Claude opprettet en MIT LICENSE-fil i et privat arkiv, noe som potensielt kan re-lisensiere proprietært arbeid som åpen kildekode.

Anthropic's respons på disse bekymringene reflekterer den konstitusjonelle tilnærmingen: transparens om begrensninger, dokumentasjon av kjente problemer, og pågående forbedring av atferdsgrenser. Selskapet vedlikeholder aktive GitHub-arkiver der brukere kan rapportere problemer og spore feilrettinger.

Claude Code's Markedsposisjon og Anthropic's Strategi

Ifølge Serie G-kunngjøringen i februar 2026, hadde Anthropic mindre enn tre år etter å ha tjent sin første dollar i inntekter, en årlig inntektsrate på 14 milliarder dollar. Den offisielle Serie G-kunngjøringen bemerker at investeringen vil drive grenseforskning, produktutvikling og infrastrukturutvidelser.

Ifølge Anthropic Economic Index publisert i januar 2026, sporer selskapet AI-adopsjon på tvers av amerikanske stater og hundrevis av yrker. Dataene viser hvordan folk bruker Claude til enten å forsterke arbeid (samarbeide med AI) eller automatisere arbeid (delegere til AI) – distinksjoner som betyr noe for sysselsettingseffekter.

I juli 2025 lanserte Anthropic Claude for Financial Services – en omfattende løsning for finansiell analyse. Financial Analysis Solution forener markedsdatafeeds og interne data fra plattformer som Databricks og Snowflake til ett enkelt grensesnitt med utvidet kapasitet for krevende finansielle arbeidsmengder.

Ifølge Anthropic's kunngjøring om Financial Services i juli 2025, overgår Claude 4-modellene andre grensemodeller som forskningsagenter på finansielle oppgaver i Vals AI's Finance Agent benchmark. Claude Opus 4 besto 5 av 7 nivåer i Financial Modeling World Cup-konkurransen med 83% nøyaktighet på komplekse Excel-oppgaver.

Ærlig talt: det er ikke bare markedsføringspåstander. Tredjeparts benchmarks gir bekreftelse på at Claude's kapabiliteter strekker seg utover konversasjonell AI til spesialiserte profesjonelle domener.

Juridiske og Samsvarsspørsmål: Hva Eierstrukturen Betyr for Brukere

Anthropic's status som et selskap med samfunnsformål skaper juridiske forpliktelser som standard selskaper ikke står overfor. Strukturen krever en balanse mellom fortjeneste og samfunnsnytte – en begrensning som teoretisk sett påvirker produktbeslutninger rundt databeskyttelse, sikkerhetsbarrierer og tilgangspolitikk.

Ifølge den offisielle dokumentasjonen for juridiske og samsvarsspørsmål for Claude Code, styres bruken av spesifikke juridiske avtaler og lisensvilkår. Selskapet tilbyr en Business Associate Agreement (BAA) for helsesamsvar, noe som viser oppmerksomhet mot kravene i regulerte bransjer.

Felleskapsdiskusjoner har reist bekymringer om datahåndtering. En Reddit-tråd beskrev en hendelse der Claude angivelig ga tilgang til en annen brukers juridiske dokumenter – en alvorlig sikkerhetsbekymring hvis den blir bekreftet. Anthropic opprettholder en prosess for rapportering av sikkerhetssårbarheter for disse problemene.

Den 3. februar 2026 lanserte Anthropic et juridisk plugin som tilpasser Claude for oppgaver som dokumentgjennomgang. Ifølge rapporter fra Legal Technology, sendte kunngjøringen bølger gjennom aksjene i juridisk programvare, med betydelige fall rapportert for Pearson, RELX (eier av LexisNexis), Thomson Reuters, Wolters Kluwer og Sage.

Ifølge rapporter fra Legal Technology, falt aksjene i London Stock Exchange Group 8,5% på grunn av bekymringer om AI's innvirkning på juridiske dataselskaper. Den markedsreaksjonen reflekterer både Claude's kapabiliteter og bekymringer om forstyrrelser for etablerte leverandører av juridisk teknologi.

Forstå Claude Code's Lisens og Vilkår

| Aspekt | Detaljer | Brukerpåvirkning |

|---|---|---|

| Programvarelisens | MIT-lisens for åpen kildekode-komponenter | Tillatelsesbasert bruk for gjennomgått kode |

| Tjenestevilkår | Styres av Anthropic's juridiske avtaler | Sjekk offisielle dokumenter for gjeldende vilkår |

| Helsessamsvar | BAA tilgjengelig for HIPAA-krav | Egnet for regulerte bransjer |

| Datahåndtering | Underlagt Anthropic's personvernregler | Gjennomgå regler for bedriftsbruk |

| Sikkerhetsrapportering | Aktiv prosess for avsløring av sårbarheter | Problemer kan rapporteres på GitHub |

Hvorfor Uavhengig Eierskap Betyr Noe for AI-utvikling

Eierstrukturen til AI-selskaper former teknologisk utvikling på måter som ikke er umiddelbart åpenbare. Når en enkelt teknologigigant eier et AI-verktøy fullstendig, er produktbeslutninger på linje med selskapets økosystem, prioriteringer og forretningsmodell.

Anthropic's uavhengighet – opprettholdt til tross for milliarder i ekstern investering – lar selskapet ta andre valg. Den konstitusjonelle AI-tilnærmingen, transparens om treningsmetoder, og strukturen som selskap med samfunnsformål, reflekterer alle prioriteringer som kan komme i konflikt med ren profittmaksimering.

Det betyr ikke at Anthropic opererer som en veldedig organisasjon. Verdsettelsen på 380 milliarder dollar reflekterer enorm kommersiell suksess og forventninger om avkastning fra investorer. Men den distribuerte eierandelen og juridiske strukturen skaper rom for sikkerhetsfokuserte beslutninger som kanskje ikke ville overlevd i et typisk bedriftsmiljø.

For utviklere som bruker Claude Code, betyr dette praktiske fordeler. Verktøyets oppførsel reflekterer treningsprioriteringer som vektlegger sikkerhet, transparens og konstitusjonelle begrensninger. Om disse prioriteringene vedvarer etter hvert som selskapet skalerer, er et åpent spørsmål – men eierstrukturen gir i det minste institusjonell støtte for å opprettholde dem.

Det Konkurransemessige Landskapet: Claude Code vs. GitHub Copilot og Cursor

Claude Code konkurrerer i et overfylt marked for AI-kodeassistenter. GitHub Copilot eies av Microsoft (gjennom sitt datterselskap GitHub). Cursor opererer som en uavhengig startup. Hver eierstruktur påvirker produktutviklingen forskjellig.

Microsofts eierskap av Copilot betyr tett integrasjon med Visual Studio Code, GitHub-arkiver og det bredere Microsoft utviklerøkosystemet. Den integrasjonen skaper bekvemmelighet, men også låsing til Microsofts plattformer.

Claude Code's terminalbaserte tilnærming og modellagnostiske design reflekterer ulike prioriteringer. Verktøyet fungerer på tvers av utviklingsmiljøer uten å kreve spesifikke IDE-plugins eller plattformforpliktelser.

Felleskapsdiskusjoner antyder sterk utviklerentusiasme for Claude Code's kapabiliteter. Ifølge WIRED, diskuterte Boris Cherny, leder for Claude Code, hvordan verktøyet endrer utviklingsarbeidsflyter – en bemerkelsesverdig anbefaling av teknologiens modenhet.

Fremtidig Utsikt: IPO-spekulasjoner og Hva Det Betyr for Eierskap

Per desember 2025 har Anthropic ifølge Capital.com ikke søkt om en børsnotering og har ikke gitt noen offentlige uttalelser som indikerer at en børsnotering er nært forestående.

Private finansieringsrunder tidlig i 2025 verdsatte Anthropic til 61,5 milliarder dollar. Serie G-finansieringsrunden i februar 2026 verdsatte selskapet til 380 milliarder dollar etter finansiering, noe som reflekterer både momentumet i AI-markedet og Anthropic's spesifikke fremdrift.

En børsnotering vil fundamentalt endre Anthropic's eierstruktur. Offentlige markedsinvestorer vil få aksjeandeler, noe som potensielt kan utvanne grunnleggerens eierandel ytterligere. Krav til offentlig rapportering vil gi transparens i finanser, kundemetrikker og operasjonelle detaljer som for øyeblikket holdes private.

Men å bli offentlig skaper også press for kvartalsvis resultatvekst som kan komme i konflikt med langsiktig sikkerhetsforskning. Spenningen mellom forventninger i offentlige markeder og prioriteringer for AI-sikkerhet kan påvirke om og når Anthropic forfølger en børsnotering.

Foreløpig forblir selskapet privat med distribuert eierskap på tvers av grunnleggere, strategiske investorer og finansielle støttespillere – en struktur som bevarer operasjonell uavhengighet samtidig som den gir massiv kapital for modellutvikling.

Ofte Stilte Spørsmål

Hvem eier Claude Code?

Claude Code eies av Anthropic, et selskap med samfunnsformål grunnlagt i 2021 av syv tidligere OpenAI-forskere, inkludert Dario Amodei (administrerende direktør) og Daniela Amodei (styreleder). Selv om store investorer som Amazon og Google har gitt milliarder i finansiering, forblir Anthropic uavhengig drevet med grunnleggere som beholder betydelige eierandeler på 2% eller mer hver per januar 2025.

Eier Amazon Claude eller Anthropic?

Nei, Amazon eier ikke Claude eller Anthropic. Amazon har gjort flere investeringsrunder som en betydelig investor i Anthropic og opprettholder et partnerskap for skyinfrastruktur gjennom AWS. Imidlertid representerer denne investeringen en minoritetsandel uten kontrollerende interesse. Anthropic's distribuerte investorgruppe og struktur som selskap med samfunnsformål forhindrer at noen enkelt enhet utøver eierskapskontroll.

Er Claude Code åpen kildekode?

Claude Code har komponenter med åpen kildekode under MIT-lisensen, noe som er tydelig i GitHub-arkivet for claude-code-security-review. Imidlertid er de underliggende Claude-modellene selv proprietære for Anthropic. Kildekoden for verktøyet er tilgjengelig på GitHub, noe som viser betydelig samfunnsengasjement og tillater bidrag fra samfunnet og transparens i funksjonaliteten.

Hvordan tjener Anthropic penger på Claude Code?

Anthropic genererer inntekter gjennom API-tilgang til Claude-modeller, bedriftslisensiering for verktøy som Claude Code, og spesialiserte løsninger som Claude for Financial Services lansert i juli 2025. Ifølge Serie G-kunngjøringen i februar 2026, nådde Anthropic's årlige inntektsrate 14 milliarder dollar, med en vekst på over 10 ganger årlig de tre foregående årene. Spesifikk prising varierer – sjekk Anthropic's offisielle nettside for gjeldende kommersielle vilkår.

Hva er et selskap med samfunnsformål og hvordan påvirker det utviklingen av Claude?

Et selskap med samfunnsformål (PBC) er en juridisk struktur som krever at selskaper balanserer aksjonæravkastning med bredere samfunnsnytte. Anthropic's PBC-status skaper juridiske forpliktelser til å vurdere AI-sikkerhet og samfunnspåvirkning ved siden av fortjeneste – noe som teoretisk sett påvirker beslutninger rundt sikkerhetsbarrierer, transparens og tilgangspolitikk. Denne strukturen skiller seg fra standard Delaware C-corps som primært fokuserer på å maksimere aksjonærverdi.

Kan Google eller Microsoft kjøpe Anthropic?

Selv om det er teknisk mulig, ville et oppkjøp kreve godkjenning fra Anthropic's styre og aksjonærer, inkludert de syv medgrunnleggerne som beholder betydelige andeler. Strukturen som selskap med samfunnsformål skaper også ytterligere hensyn utover rene finansielle vilkår. Per februar 2026 er ingen oppkjøpsdiskusjoner offentliggjort, og Anthropic fortsetter å operere uavhengig til tross for store investeringer fra teknologigiganter.

Hvem oppfant Claude AI?

Claude AI ble utviklet av teamet hos Anthropic ledet av medgrunnleggerne Dario Amodei, Daniela Amodei, Tom Brown, Jack Clark, Jared Kaplan, Sam McCandlish og Christopher Olah. Modellen bygger på forskning disse forskerne utførte ved OpenAI før de grunnla Anthropic i 2021. Tom Brown var medforfatter av GPT-3-papiret, og teamets samlede ekspertise innen store språkmodeller og AI-sikkerhet informerte Claude's utviklingstilnærming ved bruk av Constitutional AI-metoder.

Hva Dette Alt Betyr for Utviklere og Bedrifter

Å forstå hvem som eier Claude Code betyr noe av praktiske grunner utover selskapsintriger. Eierstrukturen påvirker produktets veikart, prisstabilitet, datastyring og langsiktig levedyktighet.

Anthropic's uavhengighet betyr at selskapet kan ta produktbeslutninger uten å måtte tilpasse seg et morselskaps økosystem. Claude Code fungerer på tvers av plattformer uten å favorisere spesifikke skyleverandører eller utviklingsmiljøer – fleksibilitet som reflekterer eierskapsautonomi.

Den distribuerte investorgruppen reduserer risikoen for plutselige strategiske vendinger som kan oppstå hvis en enkelt enhet kontrollerte selskapet. Når flere store investorer har andeler, krever produktbeslutninger bredere enighet i stedet for å tjene én parts interesser.

For bedrifter som vurderer AI-kodingsverktøy, gir Anthropic's status som selskap med samfunnsformål og Constitutional AI-tilnærming differensiering fra rent profittdrevne konkurrenter. Om disse strukturelle fordelene gir bedre resultater, avhenger av utførelsen – men de gir i det minste institusjonell støtte for sikkerhetsfokusert utvikling.

Selskapets raske verdiskapning fra 61,5 milliarder dollar til 380 milliarder dollar på omtrent ett år signaliserer både muligheter og volatilitet. Den banen reflekterer generelt momentum i AI-markedet og Anthropic's spesifikke fremdrift med bedriftskunder.

Konklusjon: Uavhengig Eierskap i en Æra med Dominans fra Teknologigigantene

Claude Code eies av Anthropic, ikke av Amazon, Google, Microsoft eller noen annen teknologigigant – til tross for overskrifter som antyder noe annet. De syv medgrunnleggerne som forlot OpenAI i 2021, beholder betydelige eierandeler og operasjonell kontroll gjennom Anthropic's struktur som selskap med samfunnsformål.

Store investorer leverer kapital og infrastrukturpartnerskap uten å diktere produktretningen. Den balansen mellom uavhengighet og strategisk støtte har muliggjort rask utvikling fra startup til en verdsettelse på 380 milliarder dollar på under fem år.

Eierstrukturen betyr noe fordi den former hvordan Claude Code utvikler seg. Constitutional AI-trening, transparens om kapabiliteter og begrensninger, og oppmerksomhet på sikkerhetshensyn, reflekterer alle prioriteringer som kanskje ikke overlever i et typisk bedriftsmiljø fokusert utelukkende på vekstmetrikker.

For utviklere og bedrifter betyr dette at Claude Code representerer et genuint uavhengig alternativ til verktøy eid av store teknologiplattformer. Om den uavhengigheten vedvarer etter hvert som selskapet skalerer, står overfor press for børsnotering, eller navigerer konkurransetrusler, forblir usikkert.

Men per mars 2026, opprettholder Anthropic kontrollen over Claude Code gjennom en struktur designet for å balansere kommersiell suksess med bredere hensyn til AI-sikkerhet. Det er sjeldent nok i dagens teknologilandskap til å være verdt å forstå – og å følge nøye med på etter hvert som teknologien fortsetter å forme måten vi bygger programvare på.

Ønsker du å utforske Claude Code for din utviklingsarbeidsflyt? Sjekk den offisielle Anthropic-nettsiden for gjeldende tilgangsmuligheter, prising og dokumentasjon. Eierskapet kan være komplisert, men selve verktøyet er designet for å være enkelt – naturlige språkkommandoer i terminalen din, drevet av modeller trent med innebygde sikkerhetsbegrensninger fra starten av.