خلاصه سریع: کلود کد متعلق به Anthropic است، یک شرکت با منافع عمومی که در سال ۲۰۲۱ توسط محققان سابق OpenAI، داریو و دنیلا آمودی تأسیس شد. علیرغم سرمایهگذاریهای بزرگ از سوی آمازون و گوگل، Anthropic به طور مستقل اداره میشود و هفت بنیانگذار آن همچنان سهام قابل توجهی را در اختیار دارند. کلود کد متعلق به هیچ غول فناوری واحدی نیست.

سوال "چه کسی صاحب کلود کد است؟" با توجه به اینکه این دستیار برنامهنویسی هوش مصنوعی نحوه کار توسعهدهندگان را بازتعریف میکند، اهمیت فزایندهای پیدا کرده است. با تیترهایی درباره میلیاردها دلار آمازون و جیبهای پر پول گوگل، به راحتی میتوان فرض کرد که یکی از این غولهای فناوری کنترل محصول را در اختیار دارد.

نکته اینجاست - این فرض کاملاً اشتباه است.

کلود کد متعلق به و توسعهیافته توسط Anthropic، یک شرکت ایمنی هوش مصنوعی مستقل است که به عنوان یک شرکت منافع عمومی سازماندهی شده است. و در حالی که شرکتهای بزرگ فناوری به شدت سرمایهگذاری کردهاند، هیچکدام از آنها سهام کنترلی را در اختیار ندارند یا جهتگیری محصول را دیکته نمیکنند.

بیایید ساختار واقعی مالکیت، بنیانگذاران پشت آن و دلیل اهمیت این موضوع را بیش از ترتیبهای معمول شرکتی تشریح کنیم.

کلود کد واقعاً چیست (و چرا مالکیت اهمیت دارد)

کلود کد یک ابزار برنامهنویسی عامل است که در ترمینال شما کار میکند، کدبیس شما را درک میکند و وظایف توسعه را از طریق دستورات زبان طبیعی اجرا میکند. طبق مخزن رسمی GitHub، این ابزار وظایف روتین را انجام میدهد، کد پیچیده را توضیح میدهد و گردش کار گیت را مدیریت میکند - همه اینها بدون خروج از خط فرمان.

اما این فقط یک دستیار برنامهنویسی دیگر نیست.

طبق گزارش WIRED، بوریس چرنی، رئیس کلود کد، در مورد چگونگی تغییر ابزار در گردش کار توسعه بحث کرد. این تحول در شیوههای توسعه - تبدیل شدن یک ابزار هوش مصنوعی به طور فزایندهای توانا - چیزی بنیادی را از توسعه نرمافزار سنتی متفاوت نشان میدهد.

ساختار مالکیت مهم است زیرا تعیین میکند چه کسی تکامل این فناوری را کنترل میکند، چه کسی از موفقیت آن سود میبرد و چه ارزشهایی توسعه آن را هدایت میکند. با افزایش توانایی ابزارهای هوش مصنوعی در تولید خودکار کد، این سوالات وزن واقعی دارند.

آشنایی با شرکت: ساختار منحصر به فرد Anthropic

Anthropic به عنوان یک شرکت منافع عمومی (PBC) ساختار یافته است، نه یک C-corp استاندارد دلاور. این تعیین حقوقی شرکت را ملزم میکند که بازده سهامداران را با منافع اجتماعی گستردهتر متعادل کند - محدودیتی معنیدار بر تصمیمگیری.

این شرکت در سال ۲۰۲۱ توسط هفت محقق سابق OpenAI که برای دنبال کردن رویکردی متفاوت به ایمنی هوش مصنوعی آنجا را ترک کردند، تأسیس شد. طبق ویکیپدیا، بنیانگذاران شامل داریو آمودی (مدیر عامل)، دنیلا آمودی (رئیس)، تام براون، جک کلارک، جرد کاپلان، سم مککاندلیش و کریستوفر اولاه هستند.

فوربس در ژانویه ۲۰۲۵ گزارش داد که هر یک از هفت بنیانگذار پس از چندین دور تأمین مالی، هنوز بیش از ۲٪ از شرکت را در اختیار داشتند، که نسبت به بیش از ۶٪ هر کدام در ابتدا کاهش یافته است. این مالکیت مداوم بنیانگذاران تضمین میکند که افرادی که Anthropic را ساختند، نفوذ قابل توجهی بر جهتگیری آن حفظ میکنند.

بنیانگذاران: از OpenAI به Anthropic

داریو آمودی قبل از تأسیس Anthropic به عنوان معاون تحقیقات در OpenAI خدمت میکرد. خواهرش دنیلا آمودی نقش معاون عملیات را در همان شرکت داشت. هر دو شاهد بازسازی OpenAI در سال ۲۰۱۹ از یک سازمان غیرانتفاعی به مدلی با "سود محدود" بودند - انتقالی که سوالاتی را در مورد مأموریت اصلی سازمان با تمرکز بر ایمنی ایجاد کرد.

آن تجربه فلسفه تأسیس Anthropic را شکل داد.

این تیم قبل از ترک OpenAI، تحقیقات تأثیرگذاری در مورد خطرات ایمنی هوش مصنوعی منتشر کرده بود. طبق گزارش Contrary Research، نویسندگان مشترک به دنبال انتقال خطرات ایمنی مدلهای در حال مقیاسبندی سریع بودند و آن تفکر پایه رویکرد Anthropic شد.

تام براون در حین کار در OpenAI، مقاله GPT-3 را به طور مشترک نوشت. جک کلارک قبلاً مدیر سیاست در OpenAI بود و شاخص هوش مصنوعی را در استنفورد تأسیس کرد. اینها محققان جوان نبودند که شغل خود را رها کردند - آنها رهبران ارشد بودند که به تعریف توسعه مدرن هوش مصنوعی کمک کردند.

سوابق تیم بنیانگذار مهم است زیرا آنها هم تخصص فنی و هم دانش سازمانی در مورد آنچه میتواند اشتباه پیش برود را زمانی که شرکتهای هوش مصنوعی رشد را بر ایمنی اولویت میدهند، به ارمغان آوردند. آن دیدگاه دوگانه نحوه توسعه Anthropic برای کلود کد و سایر محصولات را اطلاعرسانی میکند.

اعتبارات ابزارهای هوش مصنوعی را در یک مکان بررسی کنید

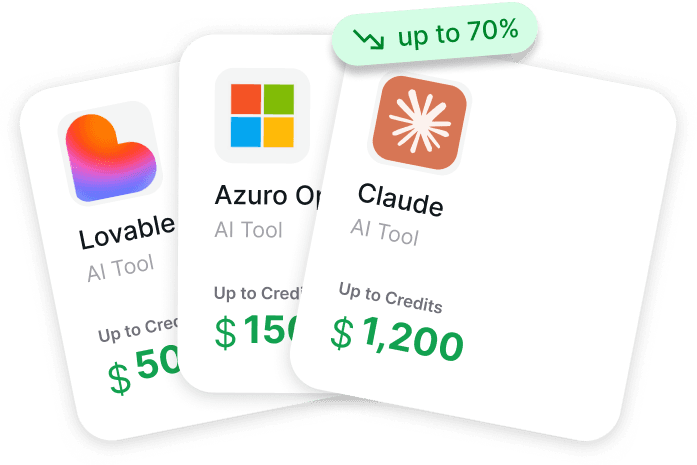

سوالات در مورد اینکه چه کسی صاحب کلود کد است، معمولاً به Anthropic و ابزارهای اطراف آن بازمیگردد. Get AI Perks اعتبارنامههای استارتاپ و تخفیفهای نرمافزاری را برای ابزارهای هوش مصنوعی و ابری در یک مکان جمعآوری میکند. این پلتفرم شامل بیش از ۲۰۰ مزیت، با پیشنهادهایی برای Anthropic، Claude، OpenAI، Gemini، ElevenLabs، Intercom و دیگران، به علاوه شرایط و راهنمای گام به گام برای ادعا است.

به دنبال اعتبارنامههای Claude یا Anthropic هستید؟

Get AI Perks را بررسی کنید تا:

- پیشنهادات Claude و Anthropic را در یک مکان پیدا کنید

- شرایط مزایا را قبل از درخواست مرور کنید

- سایر اعتبارات ابزارهای هوش مصنوعی را برای پشته خود مرور کنید

👉 برای کشف مزایای موجود Claude، Anthropic و سایر نرمافزارهای هوش مصنوعی، از Get AI Perks بازدید کنید.

به تیترها توجه نکنید: سرمایهگذاری به معنای مالکیت نیست

آمازون در چندین دور سرمایهگذاری در Anthropic انجام داده است و آن را به یک سرمایهگذار مهم تبدیل کرده است. اما آن پشتیبانی مالی، کنترل Anthropic یا Claude Code را اعطا نمیکند.

این چیزی است که آمازون واقعاً به دست میآورد: مشارکت در زیرساخت ابری از طریق AWS، دسترسی زودهنگام به مدلها برای Amazon Bedrock، و سهام اقلیت. آنچه آمازون به دست نمیآورد: کنترل هیئت مدیره، قدرت وتوی محصول، یا حقوق انحصاری فناوری Claude.

همین امر در مورد گوگل نیز صدق میکند، که سرمایه قابل توجهی سرمایهگذاری کرده و از طریق Google Cloud زیرساخت ابری را فراهم میکند. اینها مشارکتهای استراتژیک هستند، نه تملک یا سرمایهگذاریهای کنترلی.

طبق اعلامیه رسمی در فوریه ۲۰۲۶، Anthropic در دور تأمین مالی سری G به ارزش ۳۰ میلیارد دلار با ارزشگذاری پس از سرمایهگذاری ۳۸۰ میلیارد دلاری، سرمایه جمعآوری کرد. این دور توسط GIC و Coatue رهبری شد و با مشارکت D.E. Shaw Ventures، Dragoneer، Founders Fund، ICONIQ و MGX همراه بود.

سرمایهگذاران قابل توجه در آن دور شامل Accel، Addition، Alpha Wave Global، Altimeter، صندوقهای وابسته به BlackRock، Blackstone، D1 Capital Partners، Fidelity، General Catalyst، Greenoaks و Goldman Sachs Growth Equity بودند. این پایگاه سرمایهگذار متنوع، مانع از تسلط هر نهاد واحد بر تصمیمگیری میشود.

شکستن ساختار سرمایهگذاری

| سرمایهگذار | سرمایهگذاری تخمینی | نقش | سطح کنترل |

|---|---|---|---|

| آمازون | دورهای متعدد سرمایهگذاری | شریک ابری + سرمایهگذار اقلیت | سهام کنترلی ندارد |

| گوگل | چند میلیارد (افشا نشده) | شریک ابری + سرمایهگذار | سهام کنترلی ندارد |

| مایکروسافت + انویدیا | تا ۱۵ میلیارد دلار ترکیبی | شرکای زیرساخت | مشارکت، نه مالکیت |

| سرمایهگذاران سری G | دور ۳۰ میلیارد دلاری | حامیان مالی | سهام اقلیت توزیع شده |

| ۷ بنیانگذار | بیش از ۲٪ هر کدام | کنترل عملیاتی | نفوذ قابل توجه حفظ شده است |

در نوامبر ۲۰۲۵، Nvidia، Microsoft و Anthropic یک توافق مشارکت به ارزش تا ۱۵ میلیارد دلار را اعلام کردند. طبق ویکیپدیا، Anthropic موافقت کرد از سختافزار Nvidia و خدمات ابری Azure مایکروسافت استفاده کند. این سرمایهگذاری زیرساختی است، نه انتقال مالکیت.

چگونه Anthropic کلود کد را توسعه میدهد: هوش مصنوعی قانون اساسی در عمل

رویکرد توسعه Anthropic اساساً با رقبا متفاوت است. این شرکت از "هوش مصنوعی قانون اساسی" استفاده میکند - یک روش آموزشی که در آن Claude توسط مجموعهای صریح از اصول به جای یادگیری صرف از بازخورد انسانی، هدایت میشود.

در ژانویه ۲۰۲۶، Anthropic قانون اساسی جدیدی برای Claude منتشر کرد. طبق اعلامیه رسمی، این سند دقیق چشمانداز Anthropic را برای ارزشها و رفتار Claude توصیف میکند و محتوای آن مستقیماً خروجیهای Claude را در طول آموزش شکل میدهد.

قانون اساسی به عنوان مرجع نهایی برای چشمانداز Anthropic از Claude عمل میکند. تمام راهنماییها و آموزشها برای سازگاری با این اصول مستند شده است. این شفافیت نشاندهنده خروج از فرآیندهای آموزشی مبهم در سایر شرکتهای هوش مصنوعی است.

برای کلود کد به طور خاص، این به معنای آن است که ابزار با محدودیتهای ایمنی، بهترین شیوههای برنامهنویسی و ملاحظات امنیتی که در رفتار پایهای آن تعبیه شده است، آموزش داده میشود. مخزن GitHub برای claude-code-security-review این تمرکز را نشان میدهد - Anthropic یک ابزار بررسی امنیتی مبتنی بر هوش مصنوعی منتشر کرده است که از Claude برای تجزیه و تحلیل تغییرات کد برای آسیبپذیریها استفاده میکند.

بحثهای انجمن در GitHub نگرانیهایی را در مورد ایجاد خودکار فایلهای LICENSE توسط Claude Code بدون دستور صریح کاربر مطرح کرده است. یکی از مشکلات موردی را مستند کرد که در آن Claude یک فایل MIT LICENSE در یک مخزن خصوصی ایجاد کرد، که به طور بالقوه کار اختصاصی را به عنوان منبع باز مجدداً مجوز میدهد.

پاسخ Anthropic به این نگرانیها نشاندهنده رویکرد قانون اساسی است: شفافیت در مورد محدودیتها، مستندسازی مشکلات شناخته شده و اصلاح مداوم مرزهای رفتاری. این شرکت مخازن فعال GitHub را حفظ میکند که در آن کاربران میتوانند مشکلات را گزارش دهند و اصلاحات را پیگیری کنند.

موقعیت بازار کلود کد و استراتژی Anthropic

طبق اعلامیه سری G در فوریه ۲۰۲۶، کمتر از سه سال پس از کسب اولین دلار درآمد، درآمد در حال اجرا Anthropic به ۱۴ میلیارد دلار رسید. اعلامیه رسمی سری G خاطرنشان میکند که سرمایهگذاری، تحقیقات پیشرفته، توسعه محصول و گسترش زیرساخت را تأمین خواهد کرد.

طبق شاخص اقتصادی Anthropic منتشر شده در ژانویه ۲۰۲۶، این شرکت پذیرش هوش مصنوعی را در ایالتهای ایالات متحده و صدها شغل ردیابی میکند. این دادهها نشان میدهد که چگونه افراد از Claude برای تقویت کار (همکاری با هوش مصنوعی) یا خودکارسازی کار (تفویض به هوش مصنوعی) استفاده میکنند - تمایزهایی که برای تأثیر بر اشتغال مهم هستند.

در ژوئیه ۲۰۲۵، Anthropic Claude for Financial Services را معرفی کرد - یک راه حل جامع برای تجزیه و تحلیل مالی. راه حل تجزیه و تحلیل مالی، جریانهای داده بازار و دادههای داخلی را از پلتفرمهایی مانند Databricks و Snowflake در یک رابط واحد با ظرفیت گسترده برای بارهای کاری مالی سنگین یکپارچه میکند.

طبق اعلامیه خدمات مالی Anthropic در ژوئیه ۲۰۲۵، مدلهای Claude 4 در بنچمارک Finance Agent Vals AI، از سایر مدلهای پیشرفته به عنوان عوامل تحقیق در وظایف مالی بهتر عمل میکنند. Claude Opus 4، ۵ سطح از ۷ سطح مسابقات جهانی مدلسازی مالی را با دقت ۸۳٪ در وظایف پیچیده اکسل پشت سر گذاشت.

صحبت واقعی: اینها فقط ادعاهای بازاریابی نیستند. معیارهای شخص ثالث تأیید میکنند که قابلیتهای Claude فراتر از هوش مصنوعی مکالمهای به دامنههای حرفهای تخصصی گسترش مییابد.

حقوقی و انطباق: ساختار مالکیت چه معنایی برای کاربران دارد

وضعیت شرکت منافع عمومی Anthropic، تعهدات حقوقی ایجاد میکند که شرکتهای استاندارد با آنها روبرو نیستند. این ساختار نیازمند تعادل سود با منافع عمومی است - محدودیتی که به طور نظری بر تصمیمات محصول در مورد حریم خصوصی دادهها، حفاظهای ایمنی و سیاستهای دسترسی تأثیر میگذارد.

طبق اسناد رسمی حقوقی و انطباق برای کلود کد، استفاده توسط توافقنامههای حقوقی و شرایط مجوز خاصی اداره میشود. این شرکت یک توافقنامه همکاری تجاری (BAA) را برای انطباق بهداشت و درمان ارائه میدهد که نشاندهنده توجه به الزامات صنایع تحت مقررات است.

بحثهای انجمن نگرانیهایی را در مورد مدیریت دادهها مطرح کرده است. یک رشته Reddit حادثهای را توصیف کرد که در آن Claude ظاهراً دسترسی به اسناد حقوقی کاربر دیگری را فراهم کرده است - یک نگرانی امنیتی جدی در صورت تأیید. Anthropic فرآیند گزارش آسیبپذیری امنیتی را برای این مسائل حفظ میکند.

در ۳ فوریه ۲۰۲۶، Anthropic یک پلاگین حقوقی رونمایی کرد که Claude را برای وظایفی مانند بررسی اسناد سفارشی میکند. طبق گزارش Legal Technology، این اعلامیه باعث نوسان سهام نرمافزارهای حقوقی عمومی شد و کاهش قابل توجهی برای Pearson، RELX (صاحب LexisNexis)، Thomson Reuters، Wolters Kluwer و Sage گزارش شد.

طبق گزارش Legal Technology، سهام London Stock Exchange Group به دلیل نگرانی در مورد تأثیر هوش مصنوعی بر شرکتهای دادههای حقوقی ۸.۵٪ کاهش یافت. آن واکنش بازار هم قابلیتهای Claude و هم نگرانیها در مورد اختلال در فروشندگان فناوری حقوقی تثبیت شده را منعکس میکند.

درک مجوز و شرایط Claude Code

| جنبه | جزئیات | تأثیر کاربر |

|---|---|---|

| مجوز نرمافزار | مجوز MIT برای اجزای منبع باز | استفاده مجاز برای کد بررسی شده |

| شرایط خدمات | اداره شده توسط توافقنامههای حقوقی Anthropic | شرایط فعلی را برای اسناد رسمی بررسی کنید |

| انطباق مراقبتهای بهداشتی | BAA برای الزامات HIPAA موجود است | مناسب برای صنایع تحت مقررات |

| مدیریت دادهها | موضوع سیاستهای حریم خصوصی Anthropic | سیاستها را برای استفاده سازمانی بررسی کنید |

| گزارش امنیتی | فرآیند فعال افشای آسیبپذیری | مسائل را میتوان در GitHub گزارش کرد |

چرا مالکیت مستقل برای توسعه هوش مصنوعی مهم است

ساختار مالکیت شرکتهای هوش مصنوعی به روشهایی توسعه فناوری را شکل میدهد که بلافاصله آشکار نیست. وقتی یک غول فناوری واحد مالک یک ابزار هوش مصنوعی به طور کامل است، تصمیمات محصول با اکوسیستم، اولویتها و مدل کسب و کار آن شرکت همسو میشود.

استقلال Anthropic - که علیرغم میلیاردها سرمایهگذاری خارجی حفظ شده است - به این شرکت اجازه میدهد تا انتخابهای متفاوتی انجام دهد. رویکرد هوش مصنوعی قانون اساسی، شفافیت در مورد روشهای آموزشی و ساختار شرکت منافع عمومی همگی اولویتهایی را منعکس میکنند که ممکن است با حداکثرسازی سود خالص در تضاد باشند.

این به این معنی نیست که Anthropic به عنوان یک خیریه عمل میکند. ارزشگذاری ۳۸۰ میلیارد دلاری منعکس کننده موفقیت تجاری عظیم و انتظارات سرمایهگذاران از بازده است. اما مالکیت توزیع شده و ساختار حقوقی فضایی برای تصمیمگیریهای متمرکز بر ایمنی ایجاد میکند که ممکن است در یک محیط شرکتی معمولی زنده نماند.

برای توسعهدهندگانی که از Claude Code استفاده میکنند، این به دلایل عملی مهم است. رفتار ابزار منعکس کننده اولویتهای آموزشی است که بر ایمنی، شفافیت و محدودیتهای قانون اساسی تأکید دارند. اینکه آیا این اولویتها با مقیاس شرکت حفظ میشوند یا خیر، یک سوال باز باقی میماند - اما ساختار مالکیت حداقل پشتیبانی سازمانی را برای حفظ آنها ایجاد میکند.

چشمانداز رقابتی: Claude Code در مقابل GitHub Copilot و Cursor

Claude Code در بازار پررونق دستیاران برنامهنویسی هوش مصنوعی رقابت میکند. GitHub Copilot متعلق به مایکروسافت است (از طریق زیرمجموعه GitHub خود). Cursor به عنوان یک استارتاپ مستقل فعالیت میکند. هر ساختار مالکیت به طور متفاوتی بر توسعه محصول تأثیر میگذارد.

مالکیت Copilot توسط مایکروسافت به معنای ادغام نزدیک با Visual Studio Code، مخازن GitHub و اکوسیستم توسعهدهنده گستردهتر مایکروسافت است. این ادغام راحتی ایجاد میکند اما همچنین به پلتفرمهای مایکروسافت قفل میشود.

رویکرد مبتنی بر ترمینال Claude Code و طراحی مستقل از مدل، اولویتهای متفاوتی را منعکس میکند. این ابزار بدون نیاز به پلاگینهای IDE خاص یا تعهدات پلتفرم، در محیطهای توسعه کار میکند.

بحثهای انجمن نشاندهنده شور و شوق قوی توسعهدهندگان برای قابلیتهای Claude Code است. طبق گزارش WIRED، بوریس چرنی، رئیس کلود کد، در مورد چگونگی تغییر ابزار در گردش کار توسعه بحث کرد - تأیید قابل توجهی از بلوغ فناوری.

چشمانداز آینده: گمانهزنی IPO و معنای آن برای مالکیت

طبق گزارش Capital.com تا دسامبر ۲۰۲۵، Anthropic برای عرضه اولیه عمومی (IPO) اقدامی نکرده است و هیچ بیانیه عمومی مبنی بر قریبالوقوع بودن فهرست شدن منتشر نکرده است.

دورهای تأمین مالی خصوصی در اوایل سال ۲۰۲۵، Anthropic را ۶۱.۵ میلیارد دلار ارزشگذاری کرد. دور تأمین مالی سری G در فوریه ۲۰۲۶، ارزش این شرکت را پس از سرمایهگذاری ۳۸۰ میلیارد دلار ارزشگذاری کرد، که نشاندهنده هر دو روند بازار هوش مصنوعی و کشش خاص Anthropic است.

IPO ساختار مالکیت Anthropic را اساساً تغییر خواهد داد. سرمایهگذاران بازار عمومی سهام را به دست خواهند آورد و احتمالاً مالکیت بنیانگذاران را بیشتر رقیق میکنند. الزامات افشای شرکت عمومی، شفافیت در مورد جزئیات مالی، معیارهای مشتری و جزئیات عملیاتی که در حال حاضر خصوصی نگه داشته میشوند، را فراهم خواهد کرد.

اما رفتن به عموم همچنین فشاری برای رشد سود فصلی ایجاد میکند که میتواند با تحقیقات ایمنی بلندمدت در تضاد باشد. تنش بین انتظارات بازار عمومی و اولویتهای ایمنی هوش مصنوعی ممکن است بر اینکه آیا و چه زمانی Anthropic IPO را دنبال میکند، تأثیر بگذارد.

فعلاً، این شرکت خصوصی باقی میماند و مالکیت آن بین بنیانگذاران، سرمایهگذاران استراتژیک و حامیان مالی توزیع شده است - ساختاری که استقلال عملیاتی را حفظ میکند در حالی که سرمایه عظیمی را برای توسعه مدل فراهم میکند.

سوالات متداول

صاحب کلود کد کیست؟

کلود کد متعلق به Anthropic، یک شرکت منافع عمومی است که در سال ۲۰۲۱ توسط هفت محقق سابق OpenAI از جمله داریو آمودی (مدیر عامل) و دنیلا آمودی (رئیس) تأسیس شد. در حالی که سرمایهگذاران بزرگی مانند آمازون و گوگل میلیاردها دلار سرمایهگذاری کردهاند، Anthropic به طور مستقل اداره میشود و بنیانگذاران حداقل ۲٪ سهام خود را تا ژانویه ۲۰۲۵ حفظ میکنند.

آیا آمازون صاحب کلود یا Anthropic است؟

خیر، آمازون صاحب کلود یا Anthropic نیست. آمازون در چندین دور سرمایهگذاری به عنوان یک سرمایهگذار مهم در Anthropic انجام داده است و مشارکت زیرساخت ابری را از طریق AWS حفظ میکند. با این حال، این سرمایهگذاری سهام اقلیت را بدون منافع کنترلی نشان میدهد. پایگاه سرمایهگذار توزیع شده Anthropic و ساختار شرکت منافع عمومی مانع از اعمال کنترل مالکیت توسط هر نهاد واحدی میشود.

آیا کلود کد منبع باز است؟

کلود کد دارای اجزای منبع باز تحت مجوز MIT است، همانطور که در مخزن claude-code-security-review در GitHub مشهود است. با این حال، خود مدلهای Claude اختصاصی Anthropic هستند. کد منبع ابزار در GitHub موجود است، که مشارکت قابل توجه انجمن را نشان میدهد و مشارکت انجمن و شفافیت در عملکرد آن را امکانپذیر میسازد.

Anthropic چگونه از کلود کد درآمدزایی میکند؟

Anthropic از طریق دسترسی API به مدلهای Claude، صدور مجوز سازمانی برای ابزارهایی مانند Claude Code و راه حلهای تخصصی مانند Claude for Financial Services که در ژوئیه ۲۰۲۵ راهاندازی شد، درآمد کسب میکند. طبق اعلامیه سری G در فوریه ۲۰۲۶، درآمد در حال اجرا Anthropic به ۱۴ میلیارد دلار رسید و در سه سال گذشته بیش از ۱۰ برابر سالانه رشد کرده است. قیمتگذاری خاص متفاوت است - برای شرایط تجاری فعلی وبسایت رسمی Anthropic را بررسی کنید.

شرکت منافع عمومی چیست و چگونه بر توسعه Claude تأثیر میگذارد؟

یک شرکت منافع عمومی (PBC) یک ساختار حقوقی است که شرکتها را ملزم میکند بازده سهامداران را با منافع اجتماعی گستردهتر متعادل کنند. وضعیت PBC Anthropic تعهدات حقوقی را برای در نظر گرفتن ایمنی هوش مصنوعی و تأثیر عمومی در کنار سود ایجاد میکند - که به طور نظری بر تصمیمات مربوط به حفاظهای ایمنی، شفافیت و سیاستهای دسترسی تأثیر میگذارد. این ساختار با C-corps استاندارد دلاور که عمدتاً بر حداکثر کردن ارزش سهامدار تمرکز دارند، متفاوت است.

آیا گوگل یا مایکروسافت میتوانند Anthropic را خریداری کنند؟

اگرچه از نظر فنی ممکن است، هرگونه تملک نیازمند تأیید هیئت مدیره و سهامداران Anthropic، از جمله هفت بنیانگذار که سهام قابل توجهی را حفظ میکنند، خواهد بود. ساختار شرکت منافع عمومی همچنین ملاحظات اضافی فراتر از صرفاً شرایط مالی ایجاد میکند. تا فوریه ۲۰۲۶، هیچ بحث تملکی به طور عمومی افشا نشده است و Anthropic علیرغم سرمایهگذاریهای بزرگ از سوی غولهای فناوری، به طور مستقل فعالیت خود را ادامه میدهد.

چه کسی هوش مصنوعی Claude را اختراع کرد؟

هوش مصنوعی Claude توسط تیم Anthropic به رهبری بنیانگذاران مشترک داریو آمودی، دنیلا آمودی، تام براون، جک کلارک، جرد کاپلان، سم مککاندلیش و کریستوفر اولاه توسعه یافت. این مدل بر اساس تحقیقاتی ساخته شده است که این دانشمندان قبل از تأسیس Anthropic در سال ۲۰۲۱ در OpenAI انجام دادند. تام براون مقاله GPT-3 را به طور مشترک نوشت و تخصص جمعی تیم در مدلهای زبان بزرگ و ایمنی هوش مصنوعی، رویکرد توسعه Claude با استفاده از روشهای هوش مصنوعی قانون اساسی را آگاه کرد.

معنای همه اینها برای توسعهدهندگان و شرکتها

درک اینکه چه کسی صاحب کلود کد است، فراتر از جذابیت شرکتی، برای دلایل عملی اهمیت دارد. ساختار مالکیت بر نقشه راه محصول، ثبات قیمتگذاری، حاکمیت دادهها و پایداری بلندمدت تأثیر میگذارد.

استقلال Anthropic به این معنی است که شرکت میتواند تصمیمات محصول را بدون همسو شدن با اکوسیستم یک شرکت مادر اتخاذ کند. کلود کد بدون اولویت دادن به ارائهدهندگان ابری خاص یا محیطهای توسعه، در پلتفرمها کار میکند - انعطافپذیری که استقلال مالکیت را منعکس میکند.

پایگاه سرمایهگذار توزیع شده، خطر تغییرات استراتژیک ناگهانی را که ممکن است در صورت کنترل شرکت توسط یک نهاد واحد رخ دهد، کاهش میدهد. هنگامی که چندین سرمایهگذار بزرگ سهام دارند، تصمیمات محصول نیازمند اجماع گستردهتر است تا اینکه به منافع یک طرف خدمت کند.

برای شرکتهایی که ابزارهای برنامهنویسی هوش مصنوعی را ارزیابی میکنند، وضعیت شرکت منافع عمومی Anthropic و رویکرد هوش مصنوعی قانون اساسی، آنها را از رقبای صرفاً سودگرا متمایز میکند. اینکه آیا آن مزایای ساختاری به نتایج بهتری منجر میشود یا خیر، به اجرا بستگی دارد - اما حداقل پشتیبانی سازمانی را برای توسعه ایمنیمحور ایجاد میکند.

رشد سریع ارزشگذاری شرکت از ۶۱.۵ میلیارد دلار به ۳۸۰ میلیارد دلار در حدود یک سال، هم فرصت و هم ناپایداری را نشان میدهد. آن مسیر، روند کلی بازار هوش مصنوعی و کشش خاص Anthropic با مشتریان سازمانی را منعکس میکند.

نتیجهگیری: مالکیت مستقل در دوران سلطه غولهای فناوری

کلود کد متعلق به Anthropic است، نه آمازون، گوگل، مایکروسافت، یا هر غول فناوری دیگری - علیرغم تیترهایی که خلاف آن را نشان میدهند. هفت بنیانگذار که در سال ۲۰۲۱ OpenAI را ترک کردند، سهام معنادار و کنترل عملیاتی را از طریق ساختار شرکت منافع عمومی Anthropic حفظ میکنند.

سرمایهگذاران بزرگ سرمایه و مشارکتهای زیرساختی را بدون دیکته کردن جهتگیری محصول فراهم میکنند. این تعادل بین استقلال و پشتیبانی استراتژیک، توسعه سریع را از استارتاپ به ارزشگذاری ۳۸۰ میلیارد دلاری در کمتر از پنج سال امکانپذیر کرده است.

ساختار مالکیت مهم است زیرا نحوه تکامل Claude Code را شکل میدهد. آموزش هوش مصنوعی قانون اساسی، شفافیت در مورد قابلیتها و محدودیتها، و توجه به نگرانیهای ایمنی، همگی اولویتهایی را منعکس میکنند که ممکن است در یک محیط شرکتی معمولی که صرفاً بر معیارهای رشد تمرکز دارد، زنده نمانند.

برای توسعهدهندگان و شرکتها، این به این معنی است که Claude Code یک جایگزین واقعاً مستقل برای ابزارهای متعلق به پلتفرمهای بزرگ فناوری نشان میدهد. اینکه آیا آن استقلال با مقیاس شرکت، مواجهه با فشار IPO، یا پیمایش تهدیدات رقابتی حفظ میشود یا خیر، نامشخص باقی میماند.

اما تا مارس ۲۰۲۶، Anthropic کنترل Claude Code را از طریق ساختاری که برای تعادل موفقیت تجاری با ملاحظات گستردهتر ایمنی هوش مصنوعی طراحی شده است، حفظ میکند. این امر در چشمانداز فناوری امروزی به اندازه کافی نادر است که درک آن - و تماشای دقیق آن با ادامه تغییر شکل فناوری نحوه ساخت نرمافزار را ارزشمند میسازد.

آیا میخواهید Claude Code را برای گردش کار توسعه خود کاوش کنید؟ برای گزینههای دسترسی فعلی، قیمتگذاری و مستندات، وبسایت رسمی Anthropic را بررسی کنید. مالکیت ممکن است پیچیده باشد، اما خود ابزار برای سادگی طراحی شده است - دستورات زبان طبیعی در ترمینال شما، با استفاده از مدلهایی که از ابتدا با حفاظهای ایمنی تعبیه شدهاند.