Արագ ամփոփում. Claude Code-ը պատկանում է Anthropic-ին՝ 2021 թվականին նախկին OpenAI-ի հետազոտողների Դարիո և Դանիելա Ամոդեյների կողմից հիմնադրված հանրային շահի կորպորացիային։ Չնայած Amazon-ի և Google-ի կողմից խոշոր ներդրումներին, Anthropic-ը շարունակում է անկախ գործել՝ իր յոթ համահիմնադիրներով, որոնք պահպանում են զգալի բաժնեմասեր։ Claude Code-ը չի պատկանում որևէ մեկ տեխնոլոգիական հսկայի։

«Ո՞վ է տիրում Claude Code-ին» հարցը դառնում է ավելի շտապ, քանի որ այս AI ծրագրավորման օգնականը վերափոխում է մշակողների աշխատանքը։ Amazon-ի միլիարդավոր դոլարների և Google-ի խորը գրպանների մասին վերնագրերով հեշտ է ենթադրել, որ այս տեխնոլոգիական հսկաներից մեկը վերահսկում է արտադրանքը։

Բանն այն է, որ այդ ենթադրությունը ամբողջությամբ սխալ է։

Claude Code-ը մշակվում և պատկանում է Anthropic-ին՝ անկախ AI անվտանգության ընկերությանը, որը կառուցված է որպես հանրային շահի կորպորացիա։ Եվ չնայած խոշոր տեխնոլոգիական ընկերությունները մեծ ներդրումներ են կատարել, նրանցից ոչ մեկը վերահսկող բաժնեմասեր չունի կամ չի որոշում արտադրանքի ուղղությունը։

Եկեք քննարկենք իրական սեփականության կառուցվածքը, նրա ետևում ընկած հիմնադիրներին և ինչու դա ավելի կարևոր է, քան սովորական կորպորատիվ պայմանավորվածությունները։

Ինչ է իրականում Claude Code-ը (Եվ ինչու է սեփականությունը կարևոր)

Claude Code-ը գործակալային ծրագրավորման գործիք է, որը գործում է ձեր տերմինալում, հասկանում է ձեր կոդային բազան և կատարում է մշակման առաջադրանքներ բնական լեզվով հրամանների միջոցով։ Պաշտոնական GitHub պահոցի համաձայն՝ այն կատարում է սովորական առաջադրանքներ, բացատրում է բարդ կոդը և կառավարում է git աշխատանքային հոսքերը՝ առանց տերմինալից դուրս գալու։

Բայց սա ընդամենը ևս մեկ ծրագրավորման օգնական չէ։

WIRED-ի համաձայն՝ Claude Code-ի ղեկավար Բորիս Չերնին քննարկել է, թե ինչպես է գործիքը փոխում մշակման աշխատանքային հոսքերը։ Մշակման պրակտիկայի այս էվոլյուցիան՝ աճող հնարավորություններ ունեցող AI գործիքը, fundamentally տարբերվում է ավանդական ծրագրային ապահովման մշակումից։

Սեփականության կառուցվածքը կարևոր է, քանի որ այն որոշում է, թե ով է վերահսկում այս տեխնոլոգիայի էվոլյուցիան, ով է շահույթ ստանում դրա հաջողությունից, և ինչ արժեքներ են ղեկավարում դրա մշակումը։ Աճող հնարավորություններ ունեցող AI գործիքների, որոնք ունակ են ինքնուրույն կոդ ստեղծելու, այս հարցերը իրական կշիռ ունեն։

Ծանոթացեք ընկերությանը. Anthropic-ի եզակի կառուցվածքը

Anthropic-ը կառուցված է որպես հանրային շահի կորպորացիա (PBC), ոչ թե ստանդարտ Դելավերյան C-corp։ Այս իրավական կարգավիճակը պահանջում է, որ ընկերությունը հավասարակշռի բաժնետերերի եկամուտները ավելի լայն հասարակական շահի հետ՝ իմաստալից սահմանափակում սահմանելով որոշումների կայացման համար։

Ընկերությունը հիմնադրվել է 2021 թվականին յոթ նախկին OpenAI հետազոտողների կողմից, ովքեր հեռացել են՝ AI անվտանգության տարբեր մոտեցում մշակելու համար։ Wikipedia-ի համաձայն՝ համահիմնադիրների թվում են Դարիո Ամոդեին (CEO), Դանիելա Ամոդեին (նախագահ), Թոմ Բրաունը, Ջեք Քլարկը, Ջարեդ Կապլանը, Սեմ Մաքքենդլիշը և Քրիստոֆեր Օլան։

Forbes-ը 2025 թվականի հունվարին հաղորդել է, որ յոթ համահիմնադիրներից յուրաքանչյուրը դեռևս տիրապետում է ընկերության 2%-ից ավելի բաժնեմասի՝ մի քանի ֆինանսավորման փուլերից հետո, իջնելով յուրաքանչյուրի ավելի քան 6%-ից մեկնարկի պահին։ Հիմնադիրների շարունակական սեփականությունը ապահովում է, որ Anthropic-ը ստեղծած մարդիկ զգալի ազդեցություն ունենան դրա ուղղության վրա։

Հիմնադիրները. OpenAI-ից մինչև Anthropic

Դարիո Ամոդեին ծառայել է որպես OpenAI-ի հետազոտությունների փոխտնօրեն՝ մինչև Anthropic-ի հիմնադրումը։ Նրա քույրը՝ Դանիելա Ամոդեին, նույն ընկերությունում զբաղեցրել է գործառնությունների փոխտնօրենի պաշտոնը։ Երկուսն էլ ականատես են եղել OpenAI-ի 2019 թվականի վերակազմակերպմանը՝ ոչ առևտրային կազմակերպությունից դեպի «սահմանափակ շահույթ» մոդել՝ անցում, որը հարցեր է առաջացրել կազմակերպության սկզբնական անվտանգության վրա կենտրոնացած առաքելության վերաբերյալ։

Այդ փորձը ձևավորել է Anthropic-ի հիմնադիր փիլիսոփայությունը։

Թիմը հրապարակել է ազդեցիկ հետազոտություններ AI անվտանգության ռիսկերի վերաբերյալ՝ նախքան OpenAI-ից հեռանալը։ Contrary Research-ի համաձայն՝ համահեղինակները ձգտում էին հաղորդել լայնածավալ մոդելների անվտանգության ռիսկերի մասին, և այդ մտածողությունը դարձավ Anthropic-ի մոտեցման հիմքը։

Թոմ Բրաունը GPT-3 հոդվածի համահեղինակն էր OpenAI-ում աշխատելիս։ Ջեք Քլարկը նախկինում ղեկավարել է քաղաքականությունը OpenAI-ում և համահիմնադրել է AI Index-ը Ստենֆորդում։ Սրանք ոչ թե կրտսեր հետազոտողներ էին, ովքեր լքել են նավը, այլ ավագ ղեկավարներ, ովքեր սահմանել են ժամանակակից AI մշակումը։

Հիմնադիր թիմի որակավորումները կարևոր են, քանի որ նրանք բերել են ինչպես տեխնիկական փորձ, այնպես էլ ինստիտուցիոնալ գիտելիքներ այն մասին, թե ինչ կարող է սխալ գնալ, երբ AI ընկերությունները նախապատվությունը տալիս են աճին՝ անվտանգության վրա։ Այս երկակի տեսանկյունը ձևավորում է, թե ինչպես է Anthropic-ը մշակում Claude Code-ը և այլ ապրանքներ։

Մեկ տեղում ստուգեք AI գործիքների վարկերը

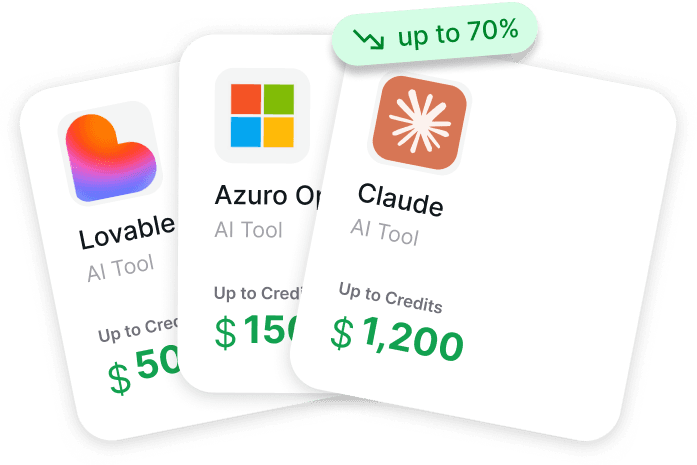

Claude Code-ի սեփականատիրոջ մասին հարցերը սովորաբար տանում են դեպի Anthropic և դրա շուրջ եղած գործիքները։ Get AI Perks-ը հավաքում է ստարտափ վարկեր և ծրագրային զեղչեր AI և ամպային գործիքների համար մեկ տեղում։ Պլատֆորմը ներառում է 200+ առաջարկներ, ներառյալ Anthropic-ի, Claude-ի, OpenAI-ի, Gemini-ի, ElevenLabs-ի, Intercom-ի և այլոց, ինչպես նաև պայմաններ և քայլ առ քայլ պահանջման ուղեցույցներ։

Փնտրու՞մ եք Claude կամ Anthropic վարկեր։

Ստուգեք Get AI Perks-ը՝

- մեկ տեղում գտնել Claude-ի և Anthropic-ի առաջարկները

- վերանայել առաջարկների պայմանները՝ մինչև դիմելը

- զննել այլ AI գործիքների վարկեր ձեր ստեկի համար

👉 Այցելեք Get AI Perks՝ ուսումնասիրելու հասանելի Claude, Anthropic և այլ AI ծրագրային առաջարկները։

Մի հավատացեք վերնագրերին. ներդրումը չի նշանակում սեփականություն

Amazon-ը մի քանի ներդրումային փուլ է կատարել Anthropic-ում՝ դարձնելով այն զգալի ներդրող։ Բայց այդ ֆինանսական աջակցությունը չի հանգեցնում Anthropic-ի կամ Claude Code-ի վերահսկողության։

Ահա թե ինչ է իրականում ստանում Amazon-ը. ամպային ենթակառուցվածքի գործընկերություն AWS-ի միջոցով, վաղ մուտք Amazon Bedrock մոդելներին և փոքրամասնության բաժնեմաս։ Այն, ինչ Amazon-ը չի ստանում. խորհրդի վերահսկողություն, արտադրանքի վետոյի իրավունք կամ Claude տեխնոլոգիայի բացառիկ իրավունքներ։

Նույնը վերաբերում է Google-ին, որը զգալի կապիտալ է ներդրել և ամպային ենթակառուցվածք է տրամադրում Google Cloud-ի միջոցով։ Սրանք ռազմավարական գործընկերություններ են, ոչ թե ձեռքբերումներ կամ վերահսկող ներդրումներ։

Փետրվարի 2026 թ. պաշտոնական հայտարարության համաձայն, Anthropic-ը հավաքել է 30 միլիարդ դոլար Series G ֆինանսավորման փուլում՝ 380 միլիարդ դոլար գնահատված գնով։ Փուլը ղեկավարել են GIC-ը և Coatue-ն, համա-ղեկավարել են D.E. Shaw Ventures-ը, Dragoneer-ը, Founders Fund-ը, ICONIQ-ը և MGX-ը։

Այդ փուլի զգալի ներդրողների թվում էին Accel-ը, Addition-ը, Alpha Wave Global-ը, Altimeter-ը, BlackRock-ի, Blackstone-ի, D1 Capital Partners-ի, Fidelity-ի, General Catalyst-ի, Greenoaks-ի և Goldman Sachs Growth Equity-ի հետ կապված հիմնադրամները։ Ներդրողների այս բազմազան բազան կանխում է որևէ մեկ միավորի կողմից որոշումների կայացման գերիշխանությունը։

Ներդրումային կառուցվածքի քանդում

| Ներդրող | Գնահատված ներդրում | Դեր | Վերահսկողության մակարդակ |

|---|---|---|---|

| Amazon | Բազմաթիվ ներդրումային փուլեր | Ամպային գործընկեր + փոքրամասնության ներդրող | Ոչ վերահսկող բաժնեմաս |

| Բազմամիլիարդ (չհայտարարված) | Ամպային գործընկեր + ներդրող | Ոչ վերահսկող բաժնեմաս | |

| Microsoft + Nvidia | Մինչև 15 միլիարդ դոլար միասին | Ենթակառուցվածքային գործընկերներ | Գործընկերություն, ոչ թե սեփականություն |

| Series G Ներդրողներ | 30 միլիարդ դոլարի փուլ | Ֆինանսական աջակիցներ | Բաշխված փոքրամասնության բաժնեմասեր |

| 7 Համահիմնադիրներ | Յուրաքանչյուրը 2%+ | Գործառնական վերահսկողություն | Պահպանված զգալի ազդեցություն |

2025 թվականի նոյեմբերին Nvidia-ն, Microsoft-ը և Anthropic-ը հայտարարեցին գործընկերության մասին, որի արժեքը կազմում է մինչև 15 միլիարդ դոլար։ Wikipedia-ի համաձայն՝ Anthropic-ը համաձայնել է օգտագործել Nvidia-ի սարքավորումները և Microsoft-ի Azure ամպային ծառայությունները։ Սա ենթակառուցվածքային ներդրում է, ոչ թե սեփականության փոխանցում։

Ինչպես է Anthropic-ը մշակում Claude Code-ը. Սահմանադրական AI-ը գործնականում

Anthropic-ի մշակման մոտեցումը fundamentally տարբերվում է մրցակիցներից։ Ընկերությունը օգտագործում է «Սահմանադրական AI»՝ մարզման մեթոդ, որտեղ Claude-ը ղեկավարվում է սկզբունքների հստակ հավաքածուով, այլ ոչ թե բացառապես մարդկային արձագանքից սովորելով։

2026 թվականի հունվարին Anthropic-ը հրապարակեց նոր սահմանադրություն Claude-ի համար։ Պաշտոնական հայտարարության համաձայն, այս մանրամասն փաստաթուղթը նկարագրում է Anthropic-ի տեսլականը Claude-ի արժեքների և վարքի վերաբերյալ, և դրա բովանդակությունը ուղղակիորեն ձևավորում է Claude-ի արդյունքները մարզման ընթացքում։

Սահմանադրությունը ծառայում է որպես վերջնական իշխանություն Anthropic-ի տեսլականի վրա Claude-ի համար։ Բոլոր ուղղորդումները և մարզումները նպատակ ունեն համապատասխանել այս փաստաթղթավորված սկզբունքներին։ Այդ թափանցիկությունը տարբերվում է այլ AI ընկերությունների ոչ թափանցիկ մարզման գործընթացներից։

Հատկապես Claude Code-ի համար դա նշանակում է, որ գործիքը մարզվում է անվտանգության սահմանափակումներով, ծրագրավորման լավագույն պրակտիկաներով և անվտանգության նկատառումներով, որոնք ներդրված են դրա հիմնարար վարքի մեջ։ claude-code-security-review-ի GitHub պահոցը ցույց է տալիս այս ուշադրությունը. Anthropic-ը թողարկել է AI-ով աշխատող անվտանգության վերանայման գործիք, որն օգտագործում է Claude-ը՝ կոդային փոփոխությունները խոցելիության համար վերլուծելու համար։

GitHub-ում համայնքային քննարկումները մտահոգություններ են բարձրացրել Claude Code-ի մասին, որն ինքնուրույն ստեղծում է LICENSE ֆայլեր՝ առանց օգտատիրոջ հստակ հրահանգի։ Մեկ խնդիր փաստագրել է դեպք, երբ Claude-ը MIT LICENSE ֆայլ է ստեղծել մասնավոր պահոցում, հնարավոր է վերանշանակել սեփականատիրական աշխատանքը որպես բաց կոդով։

Anthropic-ի պատասխանը այս մտահոգություններին արտացոլում է սահմանադրական մոտեցումը. թափանցիկություն սահմանափակումների վերաբերյալ, հայտնի խնդիրների վավերագրում և վարքի սահմանների շարունակական կատարելագործում։ Ընկերությունը պահպանում է ակտիվ GitHub պահոցներ, որտեղ օգտատերերը կարող են զեկուցել խնդիրները և հետևել ուղղումներին։

Claude Code-ի շուկայական դիրքը և Anthropic-ի ռազմավարությունը

Փետրվարի 2026 թ. Series G հայտարարության համաձայն, իր առաջին եկամտային դոլարը ստանալուց երեք տարուց պակաս ժամկետում, Anthropic-ի եկամուտների մակարդակը հասել է 14 միլիարդ դոլարի։ Series G պաշտոնական հայտարարությունը նշում է, որ ներդրումը կօգնի առաջադեմ հետազոտություններին, արտադրանքի մշակմանը և ենթակառուցվածքների ընդլայնմանը։

Համաձայն 2026 թվականի հունվարին հրապարակված Anthropic Economic Index-ի, ընկերությունը հետևում է AI-ի ընդունմանը ԱՄՆ նահանգներում և հարյուրավոր մասնագիտություններում։ Տվյալները բացահայտում են, թե ինչպես են մարդիկ օգտագործում Claude-ը՝ կա՛մ աշխատանքը ուժեղացնելու (համագործակցել AI-ի հետ), կա՛մ աշխատանքը ավտոմատացնելու (վստահել AI-ին)՝ տարբերակումներ, որոնք կարևոր են զբաղվածության ազդեցության համար։

2025 թվականի հուլիսին Anthropic-ը ներկայացրել է Claude for Financial Services-ը՝ ֆինանսական վերլուծության համար համապարփակ լուծում։ Ֆինանսական վերլուծության լուծումը միավորում է շուկայի տվյալների հոսքերը և ներքին տվյալները Databricks-ի և Snowflake-ի նման պլատֆորմներից մեկ ինտերֆեյսի մեջ՝ ընդլայնված հզորությամբ պահանջկոտ ֆինանսական ծանրաբեռնվածությունների համար։

Anthropic-ի 2025 թվականի հուլիսի Financial Services հայտարարության համաձայն, Claude 4 մոդելները գերազանցում են այլ առաջադեմ մոդելներին որպես հետազոտական գործակալներ ֆինանսական առաջադրանքներում Vals AI-ի Finance Agent բենչմարկում։ Claude Opus 4-ը հանձնել է Financial Modeling World Cup մրցույթի 7 մակարդակներից 5-ը՝ 83% ճշգրտությամբ բարդ Excel առաջադրանքներում։

Իրական խոսք. սրանք միայն մարքեթինգային պնդումներ չեն։ Երրորդ կողմի բենչմարկները հավաստում են, որ Claude-ի հնարավորությունները տարածվում են զրույցային AI-ից դուրս՝ մասնագիտական ոլորտներում։

Իրավական և համապատասխանություն. ինչ է նշանակում սեփականության կառուցվածքը օգտվողների համար

Anthropic-ի հանրային շահի կորպորացիայի կարգավիճակը ստեղծում է իրավական պարտականություններ, որոնք ստանդարտ կորպորացիաները չեն ունենում։ Կառուցվածքը պահանջում է հավասարակշռել շահույթը հանրային շահի հետ՝ սահմանափակում, որը տեսականորեն ազդում է տվյալների գաղտնիության, անվտանգության ուղեցույցների և մուտքի քաղաքականության վերաբերյալ արտադրանքի որոշումների վրա։

Claude Code-ի պաշտոնական Իրավական և համապատասխանության փաստաթղթերի համաձայն՝ օգտագործումը ղեկավարվում է հատուկ իրավական համաձայնագրերով և լիցենզիայի պայմաններով։ Ընկերությունը առաջարկում է Business Associate Agreement (BAA) առողապահության համապատասխանության համար, որը ցույց է տալիս ուշադրություն կարգավորվող ոլորտների պահանջների նկատմամբ։

Համայնքային քննարկումները մտահոգություններ են բարձրացրել տվյալների մշակման վերաբերյալ։ Մեկ Reddit թեմում նկարագրվել է միջադեպ, երբ Claude-ը, իբր, մուտք է տրամադրել մեկ այլ օգտատիրոջ իրավական փաստաթղթերին՝ լուրջ անվտանգության մտահոգություն, եթե հաստատվի։ Anthropic-ը պահպանում է անվտանգության խոցելիության մասին զեկուցման գործընթաց այս խնդիրների համար։

2026 թվականի փետրվարի 3-ին Anthropic-ը ներկայացրել է իրավական plugin, որը հարմարեցնում է Claude-ը փաստաթղթերի վերանայման նման առաջադրանքների համար։ Legal Technology-ի հաշվետվությունների համաձայն, հայտարարությունը հանգեցրել է հանրային իրավաբանական ծրագրային ապահովման բաժնետոմսերի տատանումների, Pearson-ի, RELX-ի (LexisNexis-ի սեփականատեր), Thomson Reuters-ի, Wolters Kluwer-ի և Sage-ի զգալի անկումներով։

Legal Technology-ի հաշվետվությունների համաձայն, London Stock Exchange Group-ի բաժնետոմսերը նվազել են 8.5%-ով՝ AI-ի ազդեցության վերաբերյալ մտահոգությունների ֆոնին իրավաբանական տվյալների ընկերությունների վրա։ Այս շուկայական արձագանքը արտացոլում է ինչպես Claude-ի հնարավորությունները, այնպես էլ գոյություն ունեցող իրավաբանական տեխնոլոգիական մատակարարների խափանման վերաբերյալ մտահոգությունները։

Հասկանալով Claude Code-ի լիցենզիան և պայմանները

| Ասպեկտ | Մանրամասներ | Օգտատիրոջ ազդեցություն |

|---|---|---|

| Ծրագրային լիցենզիա | MIT License բաց կոդով բաղադրիչների համար | Թույլատրելի օգտագործում վերանայված կոդի համար |

| Ծառայության պայմաններ | Ղեկավարվում է Anthropic-ի իրավական համաձայնագրերով | Ստուգեք պաշտոնական փաստաթղթերը ընթացիկ պայմանների համար |

| Առողջապահական համապատասխանություն | BAA հասանելի է HIPAA պահանջների համար | Հարմար է կարգավորվող ոլորտների համար |

| Տվյալների մշակում | Ենթակա է Anthropic-ի գաղտնիության քաղաքականությանը | Վերանայեք քաղաքականությունները ձեռնարկության օգտագործման համար |

| Անվտանգության զեկուցում | Ակտիվ խոցելիության բացահայտման գործընթաց | Խնդիրները կարող են զեկուցվել GitHub-ում |

Ինչու է անկախ սեփականությունը կարևոր AI մշակման համար

AI ընկերությունների սեփականության կառուցվածքը ձևավորում է տեխնոլոգիական մշակումը այնպես, որ դա ակնհայտ չէ։ Երբ մեկ տեխնոլոգիական հսկա ամբողջությամբ տիրում է AI գործիքին, արտադրանքի որոշումները համահունչ են այդ ընկերության էկոհամակարգին, առաջնահերթություններին և բիզնես մոդելին։

Anthropic-ի անկախությունը՝ պահպանված միլիարդավոր արտաքին ներդրումներից զատ, թույլ է տալիս ընկերությանը կատարել տարբեր ընտրություններ։ Սահմանադրական AI մոտեցումը, թափանցիկությունը մարզման մեթոդների վերաբերյալ և հանրային շահի կորպորացիայի կառուցվածքը, բոլորը արտացոլում են այն առաջնահերթությունները, որոնք կարող են հակասել մաքուր շահույթի առավելագույնին։

Դա չի նշանակում, որ Anthropic-ը գործում է որպես բարեգործական կազմակերպություն։ 380 միլիարդ դոլար գնահատումը արտացոլում է հսկայական առևտրային հաջողություն և եկամուտների վերադարձի ակնկալիքներ։ Բայց բաշխված սեփականությունը և իրավական կառուցվածքը տեղ են ստեղծում անվտանգության վրա կենտրոնացած որոշումների համար, որոնք կարող են չհաջողվել սովորական կորպորատիվ միջավայրում։

Claude Code-ն օգտագործող մշակողների համար դա գործնականում կարևոր է։ Գործիքի վարքը արտացոլում է մարզման առաջնահերթությունները, որոնք ընդգծում են անվտանգությունը, թափանցիկությունը և սահմանադրական սահմանափակումները։ Անկախ նրանից, թե այդ առաջնահերթությունները կպահպանվեն, երբ ընկերությունը ընդլայնվի, դեռևս բաց հարց է, բայց սեփականության կառուցվածքը առնվազն ապահովում է ինստիտուցիոնալ աջակցություն դրանց պահպանման համար։

Մրցակցային լանդշաֆտ. Claude Code vs. GitHub Copilot և Cursor

Claude Code-ը մրցում է AI ծրագրավորման օգնականների խիտ շուկայում։ GitHub Copilot-ը պատկանում է Microsoft-ին (իր GitHub դուստր ձեռնարկության միջոցով)։ Cursor-ը գործում է որպես անկախ ստարտափ։ Յուրաքանչյուր սեփականության կառուցվածք տարբեր կերպ է ազդում արտադրանքի մշակման վրա։

Microsoft-ի Copilot-ի սեփականությունը ենթադրում է ամուր ինտեգրացիա Visual Studio Code-ի, GitHub պահոցների և ավելի լայն Microsoft մշակողների էկոհամակարգի հետ։ Այդ ինտեգրացիան ստեղծում է հարմարավետություն, բայց նաև կախվածություն Microsoft-ի պլատֆորմներից։

Claude Code-ի տերմինալի վրա հիմնված մոտեցումը և մոդել-ագնոստիկ դիզայնը արտացոլում են տարբեր առաջնահերթություններ։ Գործիքը աշխատում է զարգացման միջավայրերում՝ առանց հատուկ IDE плугинов կամ պլատֆորմի պարտավորությունների պահանջելու։

Համայնքային քննարկումները ցույց են տալիս մշակողների ուժեղ ոգևորությունը Claude Code-ի հնարավորությունների նկատմամբ։ WIRED-ի համաձայն՝ Claude Code-ի ղեկավար Բորիս Չերնին քննարկել է, թե ինչպես է գործիքը փոխում մշակման աշխատանքային հոսքերը՝ տեխնոլոգիայի հասունության ուղղությամբ ուշագրավ հավաստում։

Ապագայի հեռանկար. IPO-ի մասին ենթադրություններ և դրա նշանակությունը սեփականության համար

2025 թվականի դեկտեմբերի դրությամբ, Capital.com-ի համաձայն, Anthropic-ը չի ներկայացրել առաջնային հրապարակային առաջարկ (IPO) և որևէ հրապարակային հայտարարություն չի արել, որը ցույց կտա, որ ցուցակումը մոտ է։

2025 թվականի սկզբի մասնավոր ֆինանսավորման փուլերը գնահատել են Anthropic-ը 61.5 միլիարդ դոլարով։ 2026 թվականի փետրվարի Series G ֆինանսավորման փուլը ընկերության գնահատականը դարձրել է 380 միլիարդ դոլար գնահատված գնով, ինչը արտացոլում է ինչպես AI շուկայի ակտիվությունը, այնպես էլ Anthropic-ի կոնկրետ տրակցիան։

IPO-ն fundamentally կփոխի Anthropic-ի սեփականության կառուցվածքը։ Հանրային շուկայի ներդրողները կստանան բաժնեմասեր, հնարավոր է՝ ավելի կրճատելով հիմնադիրների սեփականությունը։ Հանրային ընկերության հայտարարագրման պահանջները կապահովեն թափանցիկություն ֆինանսների, հաճախորդների մետրիկաների և գործառնական մանրամասների վերաբերյալ, որոնք ներկայումս պահվում են մասնավոր։

Բայց հրապարակայնությունը նաև ճնշում է ստեղծում եռամսյակային եկամուտների աճի համար, որը կարող է հակասել երկարաժամկետ անվտանգության հետազոտություններին։ Հանրային շուկայի ակնկալիքների և AI անվտանգության առաջնահերթությունների միջև լարվածությունը կարող է ազդել, թե արդյոք և երբ Anthropic-ը կզբաղվի IPO-ով։

Առայժմ ընկերությունը մնում է մասնավոր, որտեղ սեփականությունը բաշխված է հիմնադիրների, ռազմավարական ներդրողների և ֆինանսական աջակիցների միջև՝ կառուցվածք, որը պահպանում է գործառնական անկախությունը՝ միաժամանակ ապահովելով հսկայական կապիտալ մոդելների մշակման համար։

Հաճախակի տրվող հարցեր

Ո՞վ է Claude Code-ի սեփականատերը։

Claude Code-ը պատկանում է Anthropic-ին՝ հանրային շահի կորպորացիային, որը հիմնադրվել է 2021 թվականին յոթ նախկին OpenAI հետազոտողների կողմից, ներառյալ Դարիո Ամոդեին (CEO) և Դանիելա Ամոդեին (նախագահ)։ Թեև խոշոր ներդրողները, ինչպիսիք են Amazon-ը և Google-ը, միլիարդավոր ֆինանսավորում են տրամադրել, Anthropic-ը շարունակում է անկախ գործել՝ հիմնադիրների պահպանելով յուրաքանչյուրի 2% կամ ավելի բաժնեմասը 2025 թվականի հունվարի դրությամբ։

Amazon-ը տիրոջ Claude-ի կամ Anthropic-ի՞։

Ոչ, Amazon-ը չի տիրում Claude-ին կամ Anthropic-ին։ Amazon-ը մի քանի ներդրումային փուլ է կատարել որպես Anthropic-ի զգալի ներդրող և պահպանում է ամպային ենթակառուցվածքի գործընկերություն AWS-ի միջոցով։ Սակայն այս ներդրումը ներկայացնում է փոքրամասնության բաժնեմաս առանց վերահսկողական մասնակցության։ Anthropic-ի բաշխված ներդրող բազան և հանրային շահի կորպորացիայի կառուցվածքը կանխում են որևէ մեկ միավորի սեփականության վերահսկողություն իրականացնելը։

Claude Code-ը բաց կոդով է։

Claude Code-ն ունի բաց կոդով բաղադրիչներ MIT License-ի ներքո, ինչպես ապացուցված է GitHub-ում claude-code-security-review պահոցով։ Սակայն, ինքը՝ Claude մոդելները, ունի Anthropic-ի սեփականությունը։ Գործիքի աղբյուր կոդը հասանելի է GitHub-ում՝ ցույց տալով զգալի համայնքային ներգրավվածություն և թույլ տալով համայնքի ներդրումը և թափանցիկությունը դրա գործունեության մեջ։

Ինչպես է Anthropic-ը գումար աշխատում Claude Code-ից։

Anthropic-ը եկամուտներ է ստանում Claude մոդելների API մուտքի, Claude Code-ի նման գործիքների ձեռնարկատիրական լիցենզավորման և 2025 թվականի հուլիսին թողարկված Claude for Financial Services-ի նման մասնագիտացված լուծումների միջոցով։ 2026 թվականի փետրվարի Series G հայտարարության համաձայն, Anthropic-ի եկամուտների մակարդակը հասել է 14 միլիարդ դոլարի՝ աճելով ավելի քան 10 անգամ ամեն տարի վերջին երեք տարիներին։ Հատուկ գները տարբերվում են՝ ստուգեք Anthropic-ի պաշտոնական կայքը ընթացիկ առևտրային պայմանների համար։

Ի՞նչ է հանրային շահի կորպորացիան և ինչպես է այն ազդում Claude-ի զարգացման վրա։

Հանրային շահի կորպորացիան (PBC) իրավական կառուցվածք է, որը պահանջում է ընկերություններից հավասարակշռել բաժնետերերի եկամուտները ավելի լայն հասարակական շահի հետ։ Anthropic-ի PBC կարգավիճակը ստեղծում է իրավական պարտականություններ՝ AI անվտանգությունը և հանրային ազդեցությունը հաշվի առնելու շահույթի կողքին՝ տեսականորեն ազդելով անվտանգության ուղեցույցների, թափանցիկության և մուտքի քաղաքականության վերաբերյալ որոշումների վրա։ Այս կառուցվածքը տարբերվում է ստանդարտ Դելավերյան C-corp-ներից, որոնք հիմնականում կենտրոնացած են բաժնետերերի արժեքի առավելագույնացման վրա։

Կարո՞ղ են Google-ը կամ Microsoft-ը գնել Anthropic-ը։

Թեև տեխնիկապես հնարավոր է, ցանկացած ձեռքբերում կպահանջի Anthropic-ի խորհրդի և բաժնետերերի, ներառյալ յոթ համահիմնադիրների հավանությունը, ովքեր պահպանում են զգալի մասնաբաժիններ։ Հանրային շահի կորպորացիայի կառուցվածքը նաև ստեղծում է լրացուցիչ նկատառումներ՝ բացի մաքուր ֆինանսական պայմաններից։ 2026 թվականի փետրվարի դրությամբ, ձեռքբերման վերաբերյալ որևէ քննարկում չի հայտարարվել, և Anthropic-ը շարունակում է անկախ գործել, չնայած տեխնոլոգիական հսկաների կողմից խոշոր ներդրումներին։

Ո՞վ է հորինել Claude AI-ը։

Claude AI-ը մշակվել է Anthropic թիմի կողմից՝ համահիմնադիրներ Դարիո Ամոդեիի, Դանիելա Ամոդեիի, Թոմ Բրաունի, Ջեք Քլարկի, Ջարեդ Կապլանի, Սեմ Մաքքենդլիշի և Քրիստոֆեր Օլահի գլխավորությամբ։ Մոդելը հիմնված է այն հետազոտությունների վրա, որոնք այս գիտնականները կատարել են OpenAI-ում՝ նախքան Anthropic-ը 2021 թվականին հիմնադրելը։ Թոմ Բրաունը GPT-3 հոդվածի համահեղինակն է, և թիմի լեզվական մեծ մոդելների և AI անվտանգության վերաբերյալ հավաքական փորձը ձևավորել է Claude-ի մշակման մոտեցումը՝ օգտագործելով Սահմանադրական AI մեթոդները։

Ի՞նչ է սա նշանակում մշակողների և ձեռնարկությունների համար

Հասկանալ, թե ով է տիրում Claude Code-ին, կարևոր է գործնական պատճառներով՝ բացի կորպորատիվ ինտրիգներից։ Սեփականության կառուցվածքը ազդում է արտադրանքի ուղու, գների կայունության, տվյալների կառավարման և երկարաժամկետ կենսունակության վրա։

Anthropic-ի անկախությունը նշանակում է, որ ընկերությունը կարող է կայացնել արտադրանքի որոշումներ՝ առանց ծնողական ընկերության էկոհամակարգին համապատասխանեցնելու։ Claude Code-ը աշխատում է պլատֆորմներում՝ առանց հատուկ ամպային մատակարարների կամ զարգացման միջավայրերի նախապատվություն տալու՝ ճկունություն, որը արտացոլում է սեփականության ինքնավարությունը։

Բաշխված ներդրող բազան նվազեցնում է հանկարծակի ռազմավարական շրջադարձերի ռիսկը, որոնք կարող են տեղի ունենալ, եթե մեկ միավորը վերահսկեր ընկերությունը։ Երբ բազմաթիվ խոշոր ներդրողներ ունեն բաժնեմասեր, արտադրանքի որոշումները պահանջում են ավելի լայն կոնսենսուս՝ մեկ կողմի շահերը սպասարկելու փոխարեն։

Ձեռնարկությունների համար, որոնք գնահատում են AI ծրագրավորման գործիքները, Anthropic-ի հանրային շահի կորպորացիայի կարգավիճակը և սահմանադրական AI մոտեցումը տարբերակում են մատուցում բացառապես շահույթ ստանալու համար մղվող մրցակիցներից։ Արդյոք այդ կառուցվածքային առավելությունները հանգեցնում են ավելի լավ արդյունքների, կախված է կատարումից, բայց առնվազն դրանք ստեղծում են ինստիտուցիոնալ աջակցություն անվտանգության վրա կենտրոնացած մշակման համար։

Ընկերության արագ գնահատման աճը 61.5 միլիարդ դոլարից մինչև 380 միլիարդ դոլար մեկ տարուց պակաս ժամկետում ազդարարում է ինչպես հնարավորությունները, այնպես էլ անկայունությունը։ Այդ ուղին արտացոլում է AI շուկայի ընդհանուր ակտիվությունը և Anthropic-ի կոնկրետ տրակցիան ձեռնարկությունների հաճախորդների հետ։

Եզրակացություն. Անկախ սեփականություն տեխնոլոգիական հսկաների գերիշխանության դարաշրջանում

Claude Code-ը պատկանում է Anthropic-ին, ոչ թե Amazon-ին, Google-ին, Microsoft-ին կամ որևէ այլ տեխնոլոգիական հսկայի՝ չնայած վերնագրերին, որոնք հուշում են հակառակը։ Յոթ համահիմնադիրները, ովքեր լքել են OpenAI-ը 2021 թվականին, պահպանում են զգալի բաժնեմասեր և գործառնական վերահսկողություն Anthropic-ի հանրային շահի կորպորացիայի միջոցով։

Խոշոր ներդրողները տրամադրում են կապիտալ և ենթակառուցվածքային գործընկերություններ՝ առանց արտադրանքի ուղղությունը որոշելու։ Այս հավասարակշռությունը անկախության և ռազմավարական աջակցության միջև թույլ է տվել արագ զարգացում ստարտափից մինչև 380 միլիարդ դոլար գնահատական՝ հինգ տարուց պակաս ժամանակահատվածում։

Սեփականության կառուցվածքը կարևոր է, քանի որ այն ձևավորում է, թե ինչպես է Claude Code-ը զարգանում։ Սահմանադրական AI մարզումը, թափանցիկությունը հնարավորությունների և սահմանափակումների վերաբերյալ, և անվտանգության մտահոգություններին ուշադրություն դարձնելը, բոլորը արտացոլում են այն առաջնահերթությունները, որոնք կարող են չպահպանվել սովորական կորպորատիվ միջավայրում, որը կենտրոնացած է բացառապես աճի վրա։

Մշակողների և ձեռնարկությունների համար սա Claude Code-ին ներկայացնում է որպես իրականում անկախ այլընտրանք՝ խոշոր տեխնոլոգիական պլատֆորմներին պատկանող գործիքներին։ Անկախ նրանից, թե արդյոք այդ անկախությունը կպահպանվի, երբ ընկերությունը ընդլայնվի, կբախվի IPO-ի ճնշմանը կամ կկառավարի մրցակցային սպառնալիքները, մնում է անորոշ։

Բայց 2026 թվականի մարտի դրությամբ, Anthropic-ը պահպանում է Claude Code-ի վերահսկողությունը կառուցվածքի միջոցով, որը նախատեսված է առևտրային հաջողությունները AI-ի ավելի լայն անվտանգության նկատառումների հետ հավասարակշռելու համար։ Սա բավականին հազվադեպ է այսօրվա տեխնոլոգիական լանդշաֆտում, որ արժե հասկանալ՝ և ուշադիր հետևել, քանի որ տեխնոլոգիան շարունակում է վերափոխել, թե ինչպես ենք մենք կառուցում ծրագրեր։

Ցանկանու՞մ եք ուսումնասիրել Claude Code-ը ձեր մշակման աշխատանքային հոսքում։ Ստուգեք պաշտոնական Anthropic կայքը՝ ընթացիկ մուտքի տարբերակների, գների և փաստաթղթերի համար։ Սեփականությունը կարող է լինել բարդ, բայց ինքը գործիքը նախատեսված է պարզ լինելու համար՝ բնական լեզվով հրամաններ ձեր տերմինալում, որոնք սնվում են մոդելներից, որոնք մարզվել են սկզբից ներկառուցված անվտանգության սահմանափակումներով։